【RunPodリンクページ】活用マニュアル|使用方法から注目テンプレートまで

【2025年最新版】RunPodガイド・Stable Diffusionから”今注目のテンプレート”まで

本ページでは、RunPodの使い方や料金、具体的な活用方法などに関する記事のリンクをまとめたRunpod総合ページです。

導入を検討している方はもちろん、Runpodの活用方法にお困りの方も、ぜひ参考にしてみてください。

Runpodの基本的な使用方法についてはこちらの記事をご覧ください。

【RunPodの料金と使い方】Stable Diffusionなどで画像生成やLoRA学習をする方法【②実践編】 RunpodでStable Diffusion系画像生成やLoRA学習をする方法 Stable DiffusionやLoRA学習では、長時間GPUをフル稼働させるため、発熱や電源の安定性が大きな課題になりま…

目次

RunPodでテンプレートを使用する際の注意

最初に知っておくとRunPodを快適に使用できる前提知識がいくつかあります。

それは、Runpod内のテンプレートの当たりハズレについてです。

RunPodは本格派向けクラウドGPUとして非常に自由度が高く、LoRA学習やComfyUI構築など本格制作に向いていますが、

以下の点を考慮して使用するとより快適になると思います。

| 問題点 | 内容 | 補足・対策 |

|---|---|---|

| テンプレートの当たりハズレ | 更新が止まっているテンプレートがあり、Python依存やdiffusersバージョンの衝突がある。 | 最新の公式テンプレや自作テンプレを使うと安定する。古いテンプレは慎重に。 |

| UI起動トラブル | launch.py や webui-user.sh が環境依存で止まることがある(特にForge/SDXL対応テンプレ)。 | モデルを使う時には、コツがある。 |

| サポートが英語 | フォーラムは英語中心で、トラブル解決まで時間がかかることがある。 | Discordやコミュニティチャンネルで質問すると比較的早く回答が得られる。(ブラウザ版のDiscordは翻訳できる) |

RunPodは自由度と拡張性が非常に高く、豊富なテンプレートが利点ですが、一方、上記の様な更新遅延や依存関係の不整合などがあるテンプレートも存在しています。

テンプレート使用時はテンプレートの選定がカギとなります。初めのうちは安定した公式テンプレートやサポートチャンネルを活用するのがおすすめです。

■■■ 当サイトでは、押しテンプレート(使えるテンプレート)掲示板を作成いたしました(2025/10/10)。■■■

更新はゆっくりですが、安定起動したテンプレートをツール別に記載しています。

あわせて読みたい

推しテンプレート掲示板(随時更新) Runpodの使えるテンプレートと、使えないテンプレート Runpodのテンプレートには使えるものと、使えないものがあります。 すんなり立ち上がるテンプレートもあれば、ど…

2025年、注目のテンプレート

AI分野は次々と新しいツールが登場するため、どのTemplateを使えばいいのかと迷ってしまいがちです。

Runpodでは面倒な環境構築に時間を使ったり、PCのリソースを圧迫する事なく、最新の生成AIを気軽に試す事ができます。

ここでは、特に注目を集めているツールのテンプレートをご紹介します。

未来

未来実際の使い心地や特徴についても書いていますので、是非試してみて下さいね。

Fooocus の【 IK_COMFY_INSTANCE 】

Fooocus2.5.3はもう試してみましたか?

いま私が一番おすすめしたいのが、この「Fooocus 2.5.3」とSDXLモデルRunDiffusion・Juggernaut-XL-v8がセットになった IK_COMFY_INSTANCE です。

このテンプレートは、難しい設定をあれこれ考えなくても、文章をポンと入れるだけでそれなりに完成度の高い絵が出てきます。

裏ではStable Diffusionをしっかり調整してくれているので、初めての人でも感覚をつかみやすいし、なにより生成が速い!

画面もシンプルでごちゃごちゃしていない上に、「こうしたい」が直感的にできる工夫があり、ストレスなく楽しめます。

おすすめ!

Fooocus 2.5.3(Stable Diffusion)完全ガイド|ComfyUI・Automatic1111比較|SDXL・RunDiffusion対応【… Fooocusの使い方 「Fooocus(フーカス)」は Webサービス ではなく、ローカルで動かす画像生成ツール です。今回の最新版2.5.3 では、安定性や速度、アップスケーラーや…

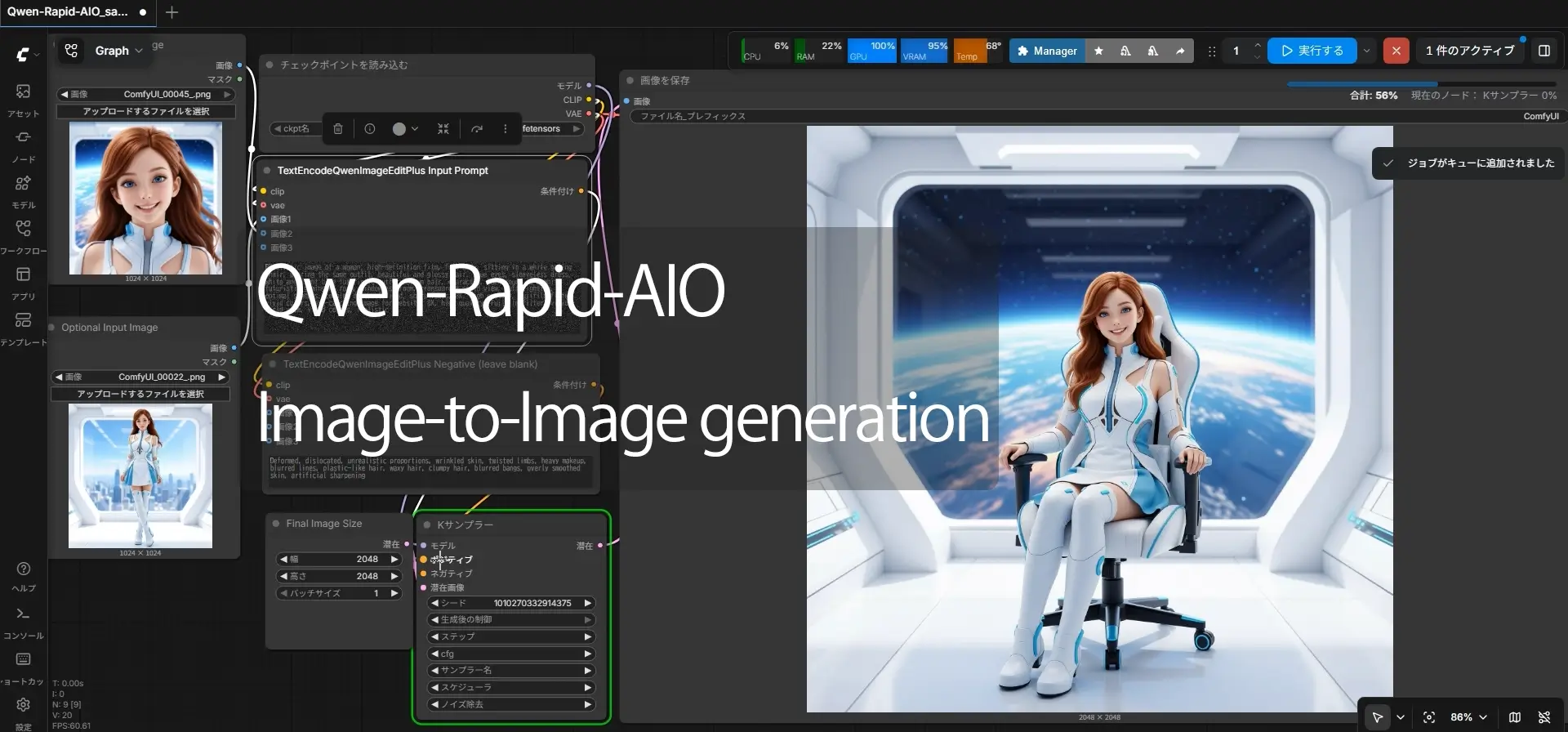

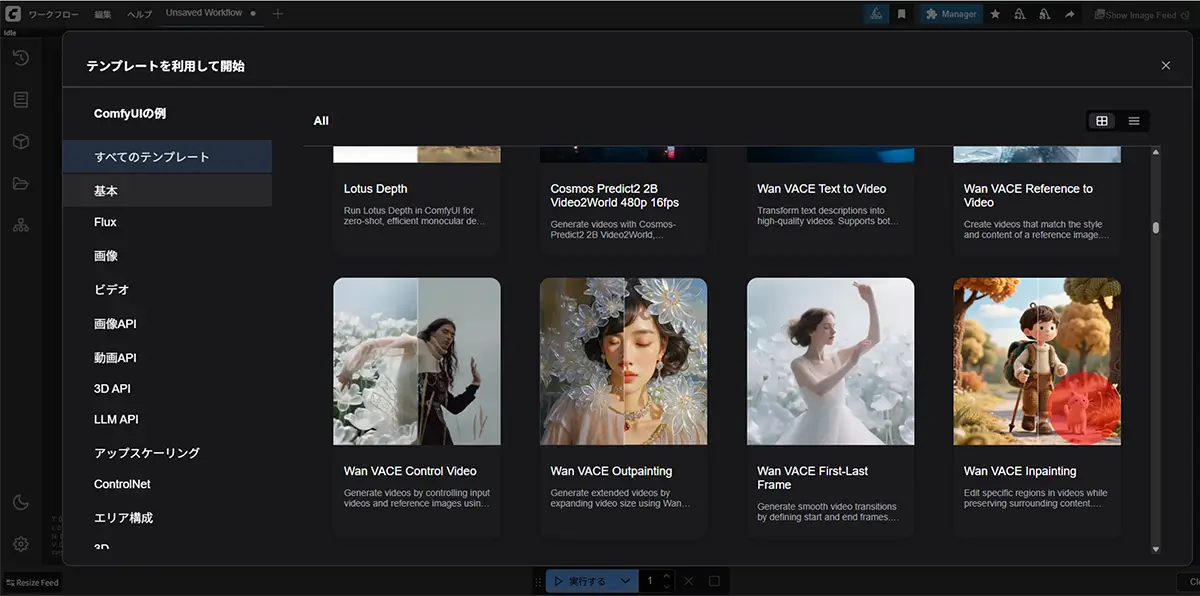

【ComfyUI + Wan】

- Wan Video(t2v:テキスト→動画、i2v:画像→動画、v2v:動画→動画)

- VACE(Alibabaの統合動画生成/編集モデル)

Comfyで画像生成に加え動画生成も使える、ComfyUI + Wanの存在は熱い。

あわせて読みたい

ComfyUI + Wanで動画生成!i2v(画像から)、flf2v(開始+終了)t2v,v2vをRunPodで簡単に使う方法 i2vで”静止画キャラから動画生成”とt2vで”テキストから動画生成” WANとは? Wanは、VACE内部で使われる 動画生成モデルで、VACE(Video-Audio-Content Engine)は、中国…

PublicEndpointで遊ぶ

Runpod Tips

活用マニュアル

最近では、画像生成だけでなくLoRA学習や拡張機能、3D動画生成と幅が広がり、自宅環境だけでは限界を感じることも少なくありません。

そんな今、心強い存在となるのがクラウドGPUです。中でも「RunPod」は、画像生成などのテンプレートがとても豊富で、安定運用に強いのが特徴です。

以下に、RunPodに関する記事をまとめました。

-

クラウドGPU”RunPod”とは?画像生成・LoRA学習の最適解?!個人利用の効率よいクラウド環境【①解説編】

-

【RunPodの料金と使い方】Stable Diffusionなどで画像生成やLoRA学習をする方法【②実践編】

-

【RunPod】で”Kohya_ss”を使用して”LoRA学習”をする方法【③応用編】

-

RunPodの【Podの見方と使い方】と【接続オプションの使い方】【⓪基礎・1.Pod編】

-

RunPod×Kohya_ss GUI|GPU非対応の原因・互換表まとめ【⓪基礎 2.GPU編】

-

「RunPodでのJupyterLabの使い方:workspaceとの違いも解説」【⓪基礎・3.JupyterLab編】

-

RunPodテンプレート”Kohya_ss GUI RTX 5090”で”LoRA学習”

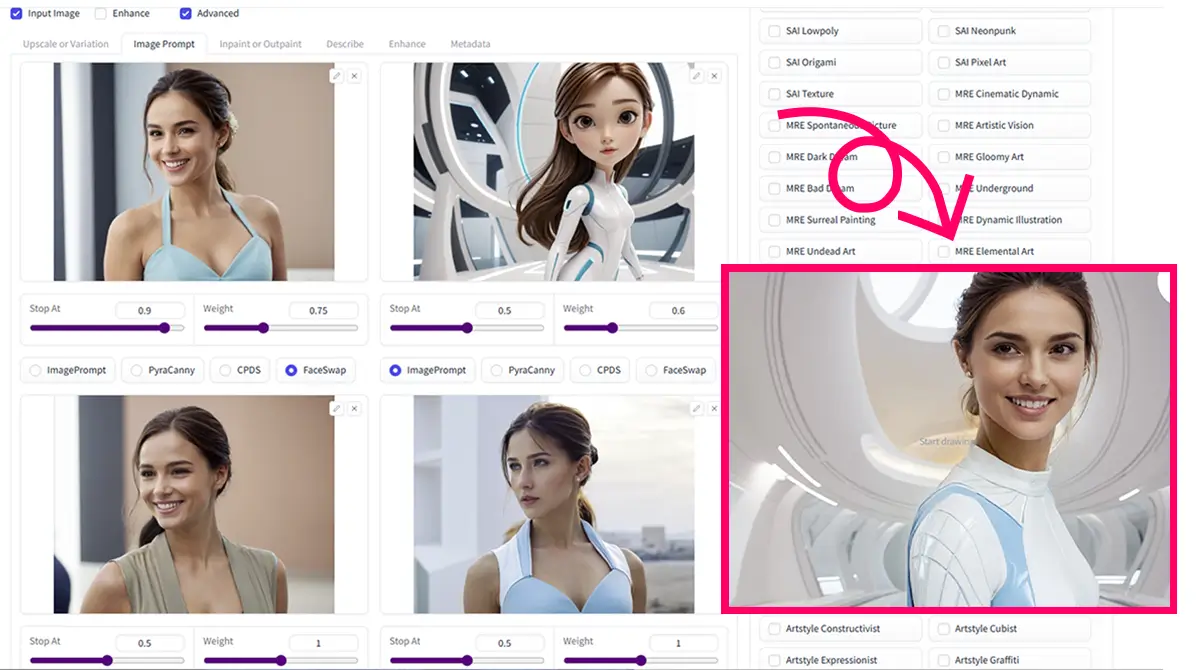

【Stable Diffusion系 WebUI】使用方法に関する記事まとめ

ここでは、Stable Diffusion系ツールの使用方法に関する記事をまとめました。

RunPodで画像生成ツールを使用する場合は、使用したいツールの入ったテンプレートを選ぶか、自分で必要な環境を構築して使用します。

-

【FaceFusion 3.4.1】手軽に顔交換!フェイススワップ完全ガイド|GUI設定まで解説【RunPod対応】

-

Fooocus 2.5.3(Stable Diffusion)完全ガイド|ComfyUI・Automatic1111比較|SDXL・RunDiffusion対応【juggernautXL v8】

-

AUTOMATIC1111 使い方|初心者向け完全ガイド(Stable Diffusion WebUI)

-

【InvokeAIの使い方】最新版InvokeAI|Stable Diffusion 使い方完全ガイド・2026年版

-

WebUI(AUTOMATIC1111)の【インストール方法】【拡張機能インストール】【エラー対処法】

-

ComfyUIとは?Stable Diffusion 各モデルの特徴・用途・対応ツールのインストールと使い方

-

【ローカル】【クラウド】【GUI】【CLI】画像生成AIを動かす7つの方法

拡張機能(Extension)

ここでは、Stable Diffusionで使用できる拡張機能の使用方法に関する記事をまとめました。

RunPodで拡張機能を使用する場合は、拡張機能付きのテンプレートを選ぶか、自分で必要な拡張機能を手動でインストールして使用します。

テンプレートによってはControlNetやReActor、LoRA対応、JupyterLab環境などがあらかじめ組み込まれているため、目的に応じた構成を選ぶことで作業効率が大幅にアップします。