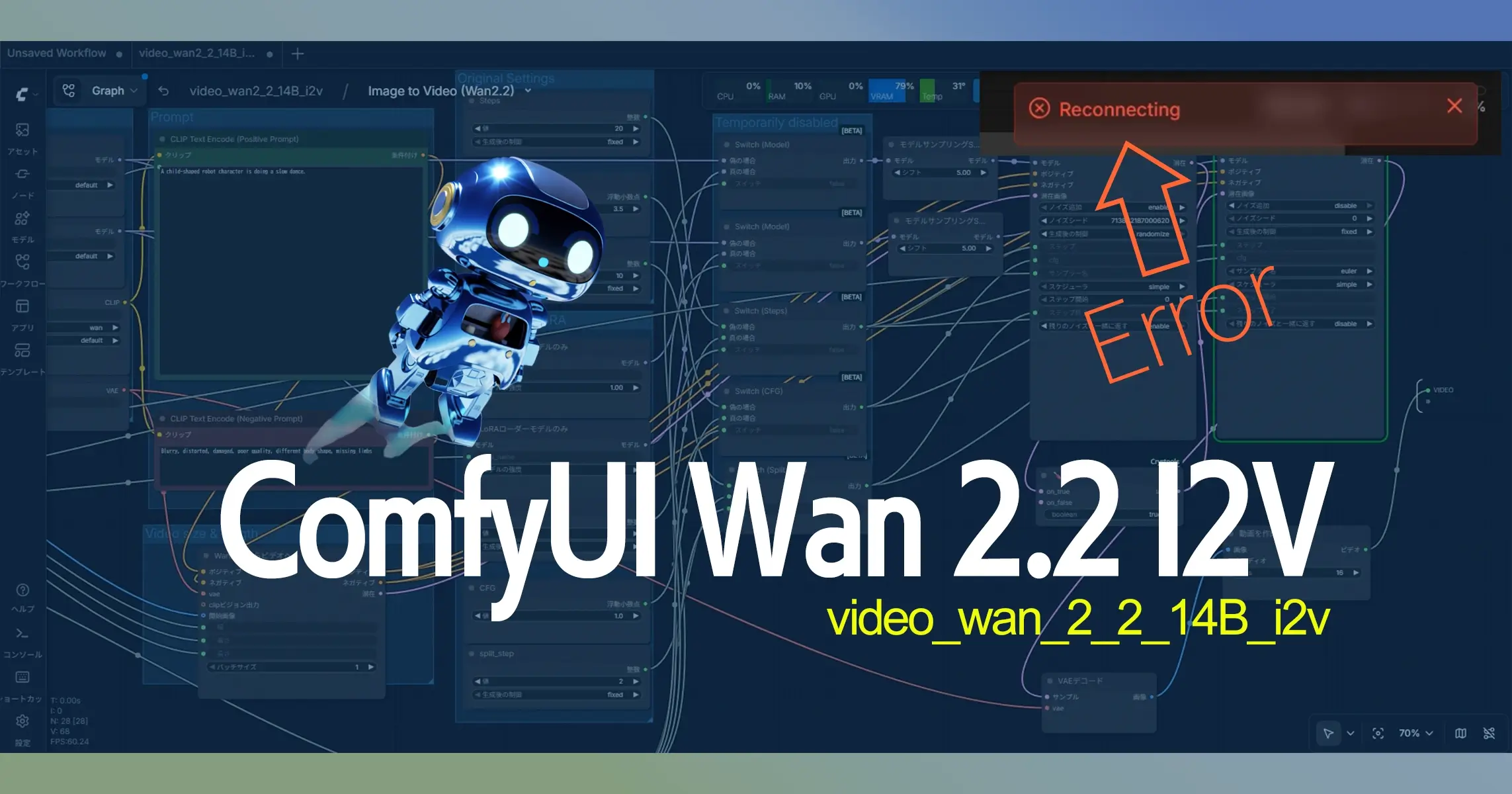

【Reconnectingエラー】ComfyUI Wan 2.2 I2V:2つ目のKSamplerでクラッシュする問題と解決法

ComfyUI Wan 2.2 I2Vのエラー

目次

Reconnecting

最近(2026年4月上旬)【video_wan_2_2_14B_i2v】WanのI2Vで2つ目のKサンプラーで毎回、停止してしまうようになりました。

色々と試しましたが、全く回復しないので困っていました。

●wan2.2_i2v_high_noise_14B_fp8_scaled

●wan2.2_i2v_low_noise_14B_fp8_scaled

今回の該当モデルは上のものです。

備考

今回の検証で、FP8形式でHighNoise+LowNoiseの2段階構造を持つモデルは同様の問題が起きる可能性がある事が予想されました。

今回確認したのはI2Vですが、fun_inpaintなども同じ構造のため注意が必要です。(後ほど詳しく書いています。)

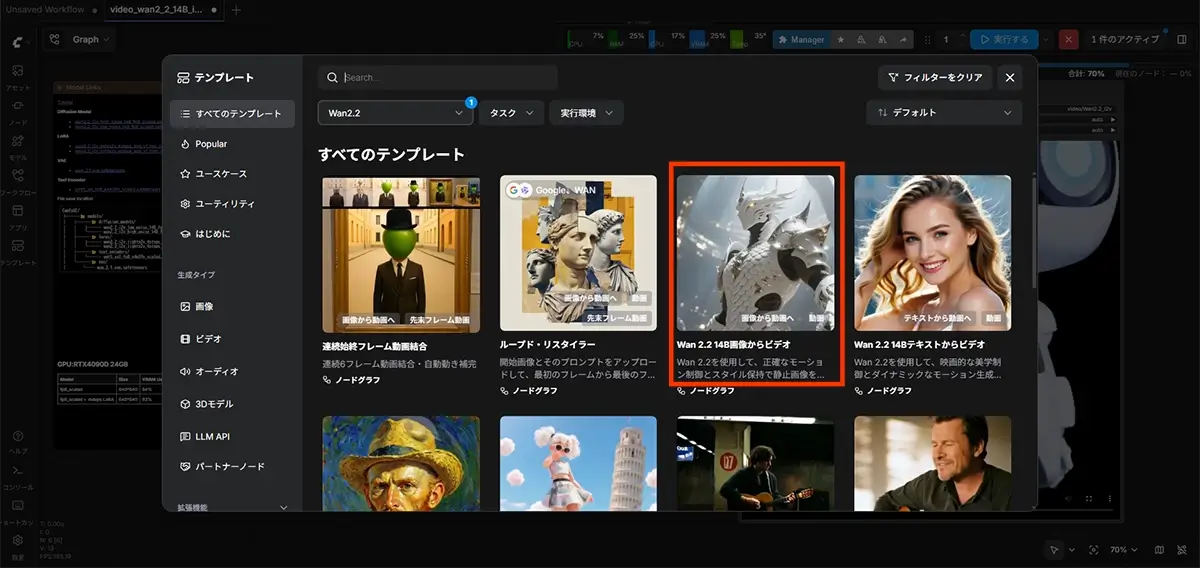

テンプレートはこちら【video_wan_2_2_14B_i2v】をカスタムして使用していました。

症状

- ComfyUI で Wan 2.2 I2V(画像→動画)を実行中

- 1つ目のKSampler(HighNoise)は正常終了

- 2つ目のKSampler(LowNoise)でエラーが出てクラッシュ

- ブラウザに「Reconnecting」と表示される

- GPU性能とは無関係に発生

今回、GPUの性能は関係なく発生しました。RTX 4090でも5090でも同じ症状が出ていました。

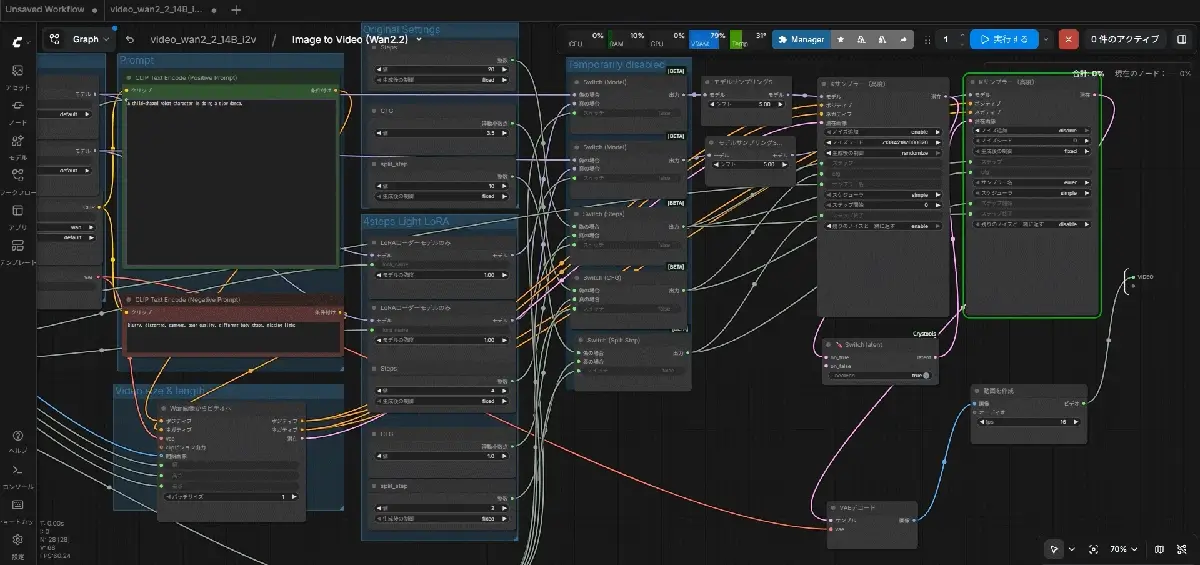

原因

FP8 safetensors × 2モデル同時使用によるVRAM不足

FP8形式のモデルを2つ同時に扱う際、HighNoise → LowNoiseの切り替わりの瞬間にVRAMが一時的に両モデル分必要になりプロセスがkillされていた事が判明しました。

エラーメッセージが出ないまま「Reconnecting」になるのはそのためでした。

GGUF(Q8_0)は整数演算ベースでGPUが計算しやすい形式のため、FP8よりも効率よく動作するようです。

というわけで、使用モデルをGGUF(Q8_0)に変更する事にしました。

| モデル形式 | 安定性 | 備考 |

|---|---|---|

| FP8 safetensors | ❌ 今回クラッシュが続いた | 2つ目のKSamplerで落ちる |

| GGUF | ✅ 安定動作 | 品質はわずかに(目視では確認しにくい程度らしい)下がる場合あり |

▶ファイル形式の違い

Safetensors(.safetensors)

- Hugging Faceが開発したモデル保存形式

- データをそのままの精度で保存している

- FP8の場合は8bit浮動小数点で保存

- 安全性重視で設計された形式(悪意あるコードが実行できない)

GGUF(.gguf)

- llama.cppチームが開発したモデル保存形式

- 量子化(データの圧縮) がセットになっている

- Q8_0なら8bit整数に変換して保存

- 1つのファイルにモデルの全情報がまとまっている

一番の違いは「量子化の方法」

FP8 safetensors → 8bit浮動小数点(float)で保存

GGUF Q8_0 → 8bit整数(int)に変換して保存浮動小数点より整数の方が計算が速く、メモリ効率も良い。

GGUFだとクラッシュしない理由

FP8 safetensorsは2つのモデルファイルを切り替える際に両方をVRAMに展開しようとする。

GGUFは読み込み方が効率的でVRAMの使い方がスマートなため、同じ操作でも余裕が生まれてクラッシュしなくなる。

けがの功名とでもいうのか、GGUFにしたら生成速度も上がりました。

クラッシュが直っただけでなく、体感でわかるくらい速くなったのは予想外の収穫でした。

解決手順(Wan2.2-I2V-A14B-GGUFへの移行)

パスは、Runpod内でのフォルダ構造で私の使用したパスのまま記載しています。

パスは環境に合わせて変更してご使用ください。

STEP

FP8モデルを削除

容量を確保するためにFP8のI2Vモデルを先に削除します。

※ 容量に余裕がある場合はこの工程は飛ばしてください。

Terminalから削除する場合

まず現在のモデルの場所を確認する

find /workspace -name "wan2.2_i2v*" 2>/dev/null※パスが確認できたら削除(パスは環境に合わせて変更)

今回削除するのは、

●wan2.2_i2v_high_noise_14B_fp8_scaled

●wan2.2_i2v_low_noise_14B_fp8_scaled

rm /workspace/madapps/ComfyUI/models/diffusion_models/wan2.2_i2v_high_noise_14B_fp8_scaled.safetensors

rm /workspace/madapps/ComfyUI/models/diffusion_models/wan2.2_i2v_low_noise_14B_fp8_scaled.safetensors削除後に空き容量を確認

df -h /workspaceSTEP

GGUFモデルをダウンロード

あわせて読みたい

QuantStack/Wan2.2-I2V-A14B-GGUF · Hugging Face We’re on a journey to advance and democratize artificial intelligence through open source and open science.

HuggingFaceトークンを準備

GGUFモデルのダウンロードにHuggingFaceのアクセストークンが必要です。

HuggingFaceのトークンを取得してから(https://huggingface.co/settings/tokens)

HuggingFaceトークン発行方法

ComfyUIで認証モデルを使う方法|Hugging Face Tokenの発行手順 HuggingFaceでのトークン発行 https://huggingface.co/settings/tokens 「Write」権限(読み込みだけなら「Read」でも可)のトークンを発行 コピーしておく モデルの…

直DLコマンド

QuantStackのリポジトリからGGUFモデルをダウンロードします

●Wan2.2-I2V-A14B-HighNoise-Q8_0.gguf

●Wan2.2-I2V-A14B-LowNoise-Q8_0.gguf

HighNoise:

wget --header="Authorization: Bearer hf_あなたのトークン" -P /workspace/ComfyUI/models/diffusion_models/ "https://huggingface.co/QuantStack/Wan2.2-I2V-A14B-GGUF/resolve/main/HighNoise/Wan2.2-I2V-A14B-HighNoise-Q8_0.gguf"LowNoise:

wget --header="Authorization: Bearer hf_あなたのトークン" -P /workspace/ComfyUI/models/diffusion_models/ "https://huggingface.co/QuantStack/Wan2.2-I2V-A14B-GGUF/resolve/main/LowNoise/Wan2.2-I2V-A14B-LowNoise-Q8_0.gguf" 未来

未来Q8_0は各約15GBです。VRAMが少ない場合はQ4_K_Mなど小さいサイズも選べます

STEP

ComfyUI-GGUFをインストール

※ggufライブラリは多くの環境に既に含まれています。念のため確認する場合cd /workspace/madapps/ComfyUI && .venv/bin/pip install gguf

GGUFモデルを読み込むための専用カスタムノードをインストール

cd /workspace/ComfyUI/custom_nodes && git clone https://github.com/city96/ComfyUI-GGUF.git GitHub

GitHub – city96/ComfyUI-GGUF: GGUF Quantization support for native ComfyUI models GGUF Quantization support for native ComfyUI models – city96/ComfyUI-GGUF

STEP

ComfyUIを再起動

再起動します。

Runpod等で、ターミナルから再起動する場合

pkill -f "python main.py"

cd /workspace/madapps/ComfyUI && nohup .venv/bin/python main.py --listen 0.0.0.0 --port 8188 &> /workspace/madapps/comfyui.log &起動完了の確認(「All startup tasks have been completed.」が出たらOK)

pkill -f "python main.py"

tail -f /workspace/madapps/comfyui.logワークフローをGGUF対応に切り替え

元のワークフローはFP8専用のUNETLoaderを使っているため、GGUF対応版への切り替えが必要です。

補足・トラブルシューティング

「Reconnecting」になってComfyUIが開かなくなった場合

ComfyUIのプロセスがクラッシュしています。ターミナルから再起動してください。VRAMが高い状態で止まっている場合は別プロセスが残っている可能性があります。

nvidia-smi pkill -f "python main.py"モデルがUIに反映されない場合

ブラウザで Ctrl+Shift+R のキャッシュなしリロードを試す。

それでも反映されない場合はComfyUIを再起動します。

なお、

GGUFモデルは通常の「UNETLoader」には表示されません。

「Unet Loader (GGUF)」ノードにのみ表示されます。

fun_inpaintも同じ問題が起きる可能性

wan2.2_fun_inpaint_high_noise / low_noise もHighNoise+LowNoiseの2段階構造を持つFP8モデルです。

I2Vと同じ問題が起きる可能性があるため、

こちらもGGUF版への切り替えを検討する必要があるかも知れません。

まとめ

| 手順 | 内容 |

|---|---|

| Step 1 | FP8モデルを削除 |

| Step 2 | HuggingFaceトークンを準備 |

| Step 3 | GGUFモデルをダウンロード(各約15GB) |

| Step 4 | ComfyUI-GGUFカスタムノードをインストール |

| Step 5 | ComfyUIを再起動 |

| Step 6 | GGUF対応ワークフローに切り替え |

SAKASA

SAKASAGGUFは安定性が大幅に向上します。RTX 5090ならQ8_0、

VRAMが少ない場合はQ4_K_Mがおすすめです。

動画の背景を美しく削除する方法

あわせて読みたい

【ComfyUI】ZhengPeng7/BiRefNetを使用して動画の背景を高精度で削除する方法 ZhengPeng7/BiRefNet BiRefNetは画像処理の“AIモデル(=処理エンジン本体)で、 最大の特徴は、髪の毛・レース・細いパーツなどの再現が強く、2K〜4Kでも劣化しにくい…

No link found in parent graph for id 「129:85」slot[7]cfg

最近多いらしいこのエラー

No link found in parent graph for id 「129:85」slot[7]cfgの対処方法の画面録画をこちらで公開しています!

最新のLoRAを検証してみました

wan2.2_i2v_A14b_lora_rank64_lightx2v_4stepをWan2.2_i2v_lightx2v_4steps_lora_v1と比較してみました。

SAKASA AI

【Wan2.2】LoRA”LightX2V”と”260412 rank64″を比較|GGUF Q8_0で4step検証【ComfyUI】 | SAKASA AI 旧LightX2Vと新260412 rank64版を比較検証。Wan2.2のLoRAによるモーション表現・カメラ移動・プロンプト反映の違いを、RTX5090実機設定とともに解説。RunPodでの導入方法、…