【Wan、BiRefNet】ComfyUIで動画の背景を差し替える3つの方法【比較まとめ】

ComfyUIで動画の背景を差し替える3つの方法

動画の背景だけを変えたい時、

どの方法が合うかわからない——そんなときのために、ComfyUIで実現できる3つのアプローチをまとめました。

それぞれ「速さ」「自然さ」「手間」のバランスが全然違いますので、用途に合わせて使い分けています。

目次

用意するもの

使用するツールは以下の三点です。

ComfyUI

BiRefNet

wan_v2v 系

ComfyUIの使い方

あわせて読みたい

ComfyUIとは?Stable Diffusion 各モデルの特徴・用途・対応ツールのインストールと使い方 ComfyUIの使い方 Stable Diffusionの代表的WebUI「AUTOMATIC1111」に続き、InvokeAIやForgeも人気が急上昇。しかし、最も高機能なツールとして注目されるのは、自由自在…

BiRefNetのダウンロード方法と使い方

BiRefNet

BiRefNetのダウンロード方法と使い方はこちらをご覧ください。

SAKASA AI

【ComfyUI】ZhengPeng7/BiRefNetを使用して動画の背景を高精度で削除する方法 | SAKASA AI ZhengPeng7/BiRefNet BiRefNetは画像処理の“AIモデル(=処理エンジン本体)で、 最大の特徴は、髪の毛・レース・細いパーツなどの再現が強く、2K〜4Kでも劣化しにくい事(…

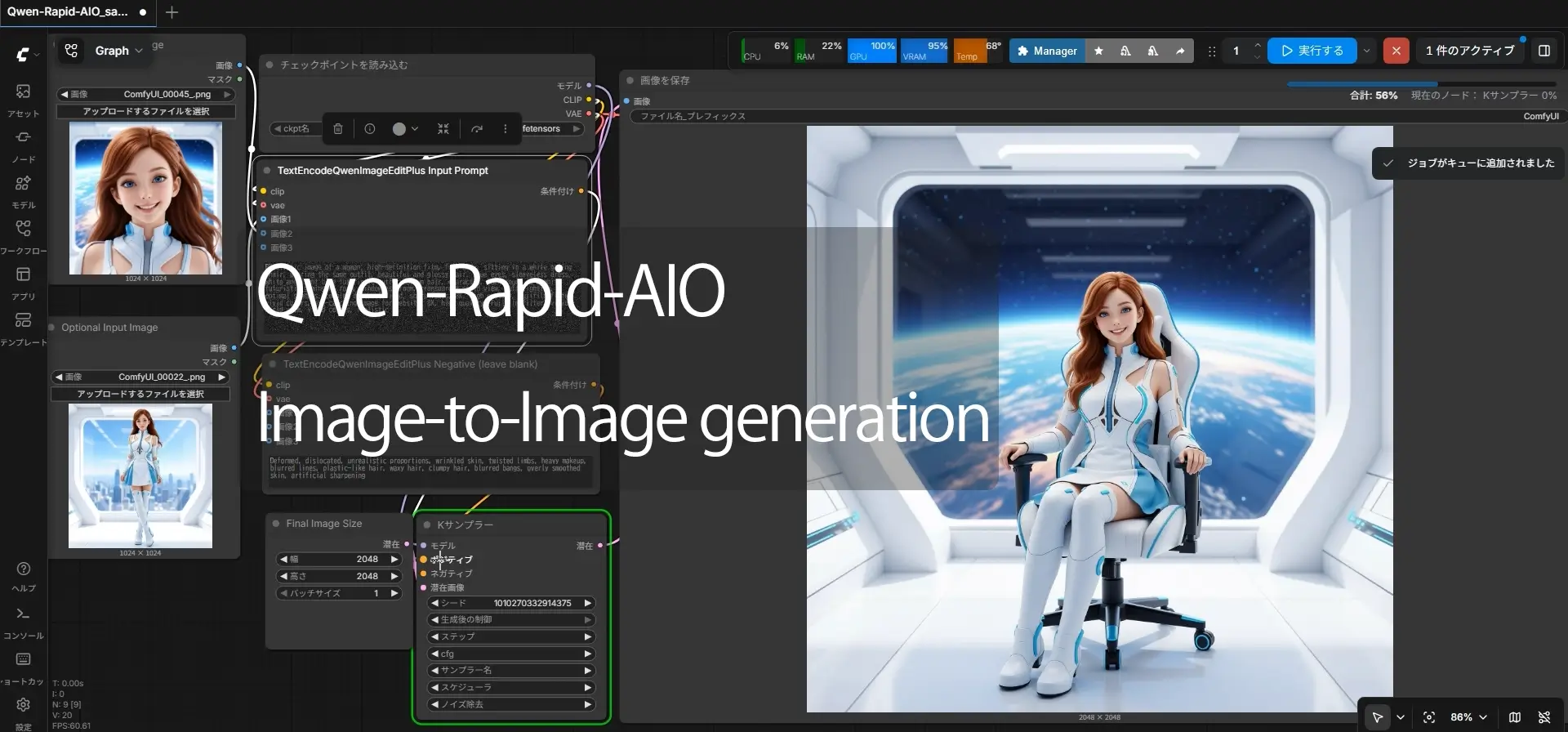

Wanの使い方

Wan

Wanについての説明と使い方はこちらをご覧ください。

あわせて読みたい

ComfyUI + Wanで動画生成!i2v(画像から)、flf2v(開始+終了)t2v,v2vをRunPodで簡単に使う方法 i2vで”静止画キャラから動画生成”とt2vで”テキストから動画生成” WANとは? Wanは、VACE内部で使われる 動画生成モデルで、VACE(Video-Audio-Content Engine)は、中国…

方法1:背景だけ再生成して合成

元動画の人物 + 別で用意した背景 → ImageCompositeMaskedで重ねる

一番シンプルで速い方法です。 背景画像や動画を自分で用意できる場合はこれが基本になります。

ワークフローの流れ

STEP

元動画を読み込む

背景を差し替えたい動画をインプットする

STEP

BiRefNetで「セグメンテーション(領域分割)」を生成する

BiRefNetの「セグメンテーション(領域分割)」を使って人物部分を自動検出し、「人物画像」と「マスク」を分離します。

精度が高く、複雑な輪郭でもそれなりにきれいに切り抜けるのが強みです。

STEP

背景素材を用意する

静止画なら Load Image、

動画なら Load Video (Upload) で読み込みます。

フリー素材でも自作でも問題ありません。

STEP

IImageCompositeMaskedで合成する

マスクを使って人物を背景に重ねます。このノードはComfyUI標準で入っているので、追加インストール不要です。

STEP

Video Combineで書き出す

フレームをつなぎ合わせて完成動画として出力します。

必要な追加ノード

これらはComfyUI標準で入っています

| ノード | 役割 |

|---|---|

ImageCompositeMasked | 人物を背景に重ねる |

Load Image | 背景画像を読み込む |

Load Video(Upload) | 背景動画を読み込む場合 |

クオリティを上げたい場合

IC-Light を追加すると、背景に合わせてライティングを自動で調整してくれます。単純合成だとどうしても「切り抜いて貼った感」が出やすいのですが、IC-Lightを挟むだけでかなり自然な仕上がりになります。背景がスタジオっぽい場合や、屋外の光が強いシーンでは特に効果的です。

方法2:Video to Videoで背景を変える

AIにすべてを丸投げする方法です。 マスクを作ったり背景を用意したりといった手間がなく、プロンプトを書くだけで完結します。ただし「お任せ」な分、思い通りにならないこともあります。

ワークフローの流れ

STEP

Load Video (Upload)

動画を読み込み、フレームを画像として展開します。

STEP

Wan Video2Video

プロンプトで仕上がりを指定します。

例:”ballet dancer, forest background, cinematic lighting”

strength の値がキモで、ここで結果が大きく変わります。

- 低い(0.3〜0.5):元動画に近い仕上がり。背景の変化は控えめ

- 高い(0.7〜0.9):背景はしっかり変わるが、人物も一緒に変わりやすい

背景をがっつり変えたいなら高め、人物を守りたいなら低めに設定して何度か試すのがおすすめです。

STEP

Video Combineで書き出す

デメリット

| 問題 | 内容 |

|---|---|

| 人物が変わる | 顔・体型・衣装が微妙に変わりやすい |

| 動きがズレる | 元動画と完全一致しない |

| 重い | Runpodでもそれなりに時間がかかる |

手軽さと引き換えに制御のしにくさがあるので、「雰囲気が変わればOK」くらいのユースケースに向いています。人物の再現性が重要なシーンには不向きです。

方法3:Wanインペインティング

人物マスク → 背景部分だけWanで再生成

3つの中で一番自然な仕上がりになる方法です。

方法①と違って背景をWanが生成するため、人物と背景の光源・雰囲気が自然に馴染みます。その分、処理は最も重いです。

- 背景はWanが自動生成する

- 処理が重い

- 背景と人物が自然に馴染む

ワークフローの流れ

STEP

元動画

元動画を用意する

STEP

BiRefNetで「セグメンテーション(領域分割)」

人物部分だけを「セグメンテーション(領域分割)」します。ここは方法①と同じです。

STEP

Wanインペインティングで背景を再生成

「セグメンテーション(領域分割)」した背景部分だけをWanが新たに生成します。人物はいじらず、背景だけが差し替わるイメージです。

STEP

完成

人物はそのまま、背景だけが変わった動画が出力されます。

①と③の違い

①合成

「セグメンテーション(領域分割)」 + 別途用意した背景画像/動画

↓

ImageCompositeMaskedで重ねるだけ

シンプルで速いがライティングが不自然になりやすい

③インペインティング

「セグメンテーション(領域分割)」→ 背景部分だけWanで再生成

↓

元動画の人物はそのまま残る

一番自然だがWanを使うので重くて時間がかかります。

結局どれから試すか迷ったら・・・

個人的な結論としては、「Wanで背景を生成して、合成はImageCompositeMaskedでやる」というハイブリッドが一番シンプルで効率的 だと感じています。

- 背景素材を自分で用意できる → 方法①

- とにかく手軽に試したい → 方法②(ただし結果は運ゲー気味)

- クオリティ重視、時間をかけてもいい → 方法③

ただし、どの方法も元動画の品質によって結果がかなり変わります。髪の毛の細かい動きや、背景と人物の境界がはっきりしない動画は、どの方法でも難易度高めです。まずは短いクリップで試してから本番に臨むのがおすすめです。

SAKASA AI

アルファチャンネル付き透過PNGをDaVinci Resolveで編集する方法 | SAKASA AI アルファチャンネル付き透過PNGの扱い方 今回は、BiRefNetが出力したアルファチャンネル付き透過PNG(8bit PNG)をDaVinci Resolveで正しく扱うポイントについてまとめまし…

SAKASA AI

ComfyUI + Wanで動画生成!i2v(画像から)、flf2v(開始+終了)t2v,v2vをRunPodで簡単に使う方法 | SAKAS… ComfyUI + WanでAI動画生成!i2v(画像→動画)、flf2v(開始+終了)t2v(テキスト→動画)、使い方をRunPod環境でわかりやすく解説。GPU目安やテンプレート設定も掲載。

Wanの最新LoRAを試して旧モデルと比較してみました

SAKASA AI

【ComfyUI WAN】LoRA”旧LightX2V”と”最新260412 rank64″の違い|GGUF Q8_0で4step比較 | SAKASA AI 旧LightX2Vと260412 rank64の違い 今回の比較 プロンプト 子供型ロボットがコンテンポラリーダンスを踊っている、胸に配置された心臓型のオブジェがわずかに鼓動している、…