【2026年版】自分だけの画像が生成したい!と思った時の軽量な学習モデル

本記事では、”自分の描いた絵”を学習させて、自分専用の画像生成AIを作りたい!と思った時に使えるAI、種類、方法についてまとめました。

【比較表】画像生成AIの学習手法(2025年版)

| 手法 | 特徴 | 向いている用途 | データ量 | 学習コスト | 出力品質 | 備考 |

|---|---|---|---|---|---|---|

| LoRA (SD1.5/SDXL) | 軽量・柔軟・安定した主流手法 | 絵柄・キャラ・ポーズの再現 | 10〜30枚 | 中(VRAM6〜12GB) | ◎ | 現在も王道 |

| DreamBooth | 高再現・高精度 | 人物写真・高忠実なキャラ再現 | 20〜100枚 | 高(VRAM12GB〜) | ◎◎ | SDXL対応版も登場 |

| Textual Inversion | 概念・名前など少量で学習 | 特定のモチーフ・小物・顔など | 3〜10枚 | 低 | △〜○ | 出力は安定しにくい |

| ControlNet | 絵柄ではなく「構図」や「姿勢」の制御に特化 | ポーズ指定・線画生成との組合せ | 画像なしでも可 | なし(推論時制御) | – | LoRAと併用◎ |

| IP-Adapter / StyleAdapter | 外部画像から「作風」を転送 | スタイル変換・雰囲気再現 | 学習不要 | なし | ◎ | 実験的だが高精度 |

| StyleAlign / StyleResampler | 作風そのものを学習・転送 | 画風変換・イラストの一貫性 | 不明(研究段階) | 不明 | ◎? | 現在は論文・実験用途 |

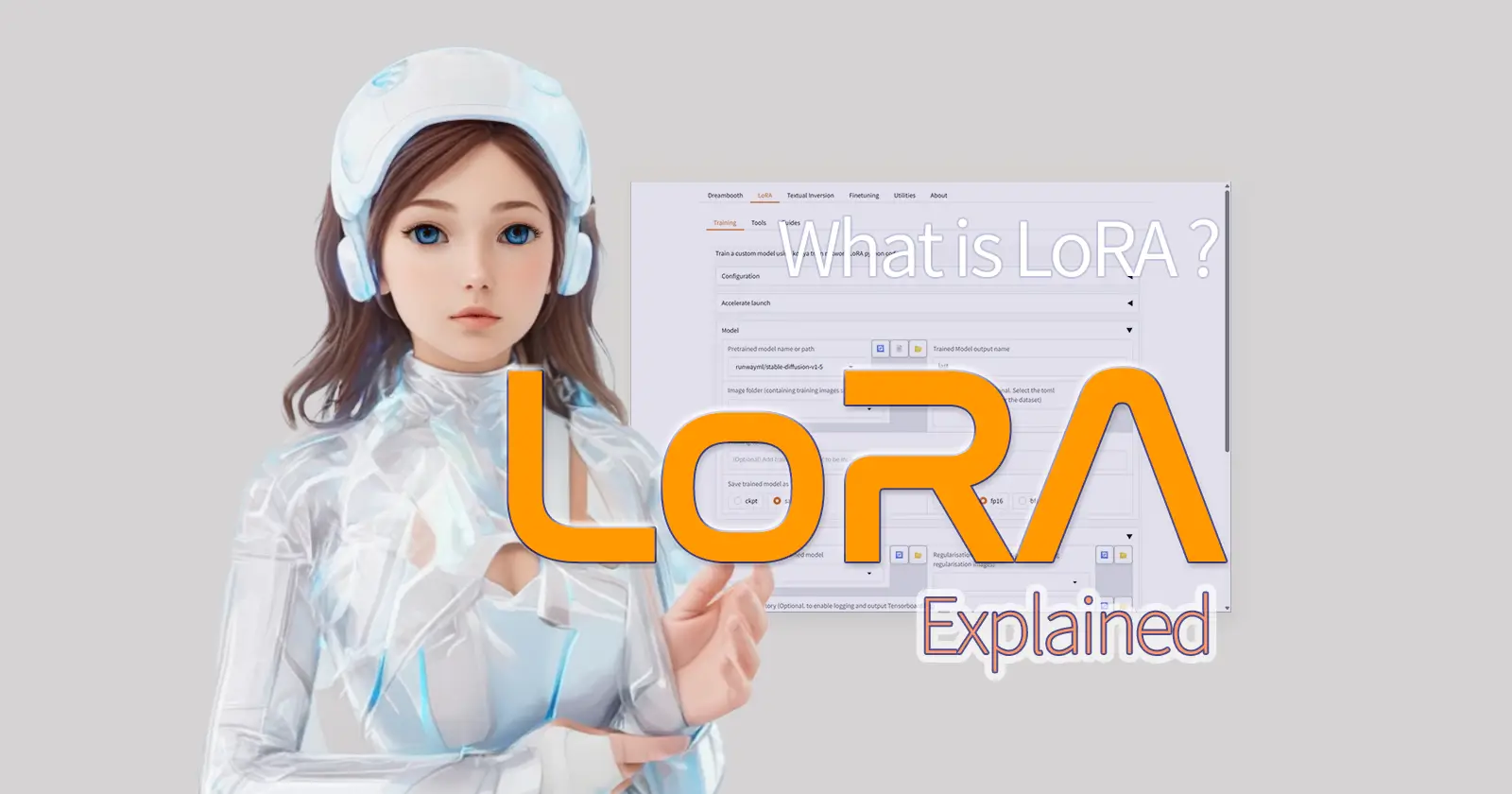

1. Stable Diffusion + LoRA(Low-Rank Adaptation)

- 自分の絵をベースにした軽量な学習モデルを作れます。

- 通常、10〜20枚程度の画像でも学習できます。

- DreamBoothよりも軽く、環境構築がしやすいのも魅力。

- オープンソースで、ローカルやGoogle ColabでもOK。

LoRAは今でも非常に強力で、軽量で扱いやすい「現役の王道手法」です。 しかし、2025年の現在では、それ単体ではなく 他の手法と組み合わせて使う時代 に突入しているのかも知れません。

- 制御系(ControlNet)で構図を補い

- スタイル転送(IP-Adapter)で作風を拡張し

- 必要ならDreamBoothで高再現を狙う

自分の創作スタイルに合わせて「ベストな道具」を選ぶ。それが、2025年の画像生成AI活用の鍵と言えるだろう。

こうした柔軟な組み合わせによって、より自由で安定した画像生成が可能になります。

- LoRA Block Weight で細かい反映度の調整

- SDXL対応LoRA による高精細な学習

- マージツールの高機能化 で汎用モデル作成も可能に

自分の絵を「教え込んだAI」を使って、

新しい発想で作品を生み出したり、漫画や絵本、グッズ展開なども!

あわせて読みたい

LoRAとは?仕組み・学習・使い方・学習パラメータまで【LoRA完全ガイド】 LoRAとは何か? LoRAとは、Low-Rank Adaptation(低ランク適応)の略で、大規模なモデル(例:Stable Diffusion)の重みをすべて再学習するのではなく、一部だけを効率…

2. DreamBooth(Stable Diffusionベース)

- こちらも自分専用モデルを作る方法で、比較的高精度。

- LoRAより重い。

- DreamBooth と LoRA の違いは「学習方法」と「必要なデータ量・リソース」

あわせて読みたい

DreamBooth(ドリームブース)学習 DreamBooth学習は、特定の人や物を、AI画像生成モデルに覚えさせる学習方法で、Stable Diffusionなどの既存モデルに対して、たった数枚の写真(通常3~30枚)を使って、…

3. 自作データセット × fine-tuning

- 自分の絵を大量に(100枚以上)用意して、本格的にモデルを再学習。

- ハードルは高いですが、完全オリジナルスタイルにできます。

- 自分のタッチや世界観をそのままAIに反映できる

- 生成画像の著作権的な問題が最小限に抑えられる(元が自作のため)

- SNSや販売などにおいて「完全オリジナルAIアート」として発信できます。

注意点

- モデル出力が他人の作品に似すぎないようにする(一般モデルの影響を排除したいなら学習元に注意)

- キャプションの付け方次第で出力がブレやすい

- モデルの再配布や商用利用にはライセンス確認が必要です!

参考になるリンク(日本語情報も豊富)

- CivitAI:LoRAのモデル共有サイト。自作LoRAも投稿できます。

- Hugging Face:Stable DiffusionのベースモデルやLoRAのホスティング多数。

- Google ColabのDreamBooth / LoRAノートブック:ノーコードで学習可能な人気プロジェクト。

SAKASA AI

【2025年版】Civitaiの見方と使い方|LoRA・Checkpointモデルの選び方 | SAKASA AI Civitaiの使い方を完全ガイド!初心者でも安心のモデル選び・安全なダウンロード方法・LoRAやCheckpointの違いを徹底解説。Stable Diffusionで理想の画像を作ろう。

SAKASA AI

初心者でも難しくない!Hugging Faceで始めるAI画像生成モデルの使い方 | SAKASA AI Hugging Faceとは? AIの話題でよく聞く「Hugging Face(ハギングフェイス)」。 Hugging Faceは、世界中のAIモデルやツールを誰でも手軽に試せるAIのオープンプラットフォ…

目次

ファインチューニングの仕組み

「fine-tuning(ファインチューニング)」は、すでに学習済みのAIモデルに、自分独自のデータを追加で学習させて“微調整”すること を指します。

大規模なAIの“土台”はそのままに、特定のスタイルや目的に合わせて仕立て直すことです。

AIモデルは、何千万枚もの画像を使って「一般的な世界の知識」を学習しています。でも、それだけでは「自分の絵柄」や「自分の世界観」は出せません。そこで登場するのが「fine-tuning」です。

1. ベースモデルを選ぶ

まずは、Stable Diffusion 1.5 など、既に公開されているAI画像生成モデルを使用して絵柄を学習させていきます。

2. イラストを準備

- 通常は50〜500枚程度あると効果的(LoRAやDreamBoothより多め)。

- 統一感のあるスタイルで揃えると精度アップ。

3. 学習用のキャプションをつける

- 画像ごとに「水彩風の猫」「夜の街、アニメ調」といった短い説明をつける。

4. モデルを再学習(微調整)

- すでに学習済みのモデルに、あなたのデータを追加して学習。

- 新しいモデルファイルが生成され、それを使えば「あなたっぽい画像」が出力されます。

ファインチューニングとLoRA/DreamBoothの違い

| 項目 | Fine-tuning | DreamBooth | LoRA |

|---|---|---|---|

| 精度 | 高い(大量データでOK) | 中〜高 | 中〜高(軽量) |

| 処理時間 | 長い(数時間〜) | 中程度(30〜60分) | 短い(15〜30分) |

| データ量 | 多い(50枚以上〜数百) | 少なめでも可(10枚〜) | 少なめ(10〜30枚) |

| 柔軟性 | 高い(完全自分仕様) | 高め | 高い(後付けOK) |

Fine-tuningを使ってできる事

- 自分の絵柄で物語の1シーンを量産

- オリジナルキャラをAIで描き続ける

- 同じタッチで背景や構図だけ変えた画像が生成できる

- ノベルゲームや絵本などへの応用も現実的!

注意点とコツ

- 使う画像のスタイルがバラバラだと学習がうまくいかないことがあります。

- モデルの再配布や商用利用をする場合は、元モデルのライセンスをチェックしましょう。

- **学習環境(GPU)**が必要です。自身PC(ローカル環境)で使用する方法の他に、

RunPodなどのクラウドレンタルGPUがあれば出来ます。

あわせて読みたい

【RunPodとは?】Stable Diffusion/ComfyUI・LoRA学習の最適クラウドGPU環境【①解説編】 画像生成、動画生成、Lora学習から3D生成まで使いやすい! 本サイトでは、使い倒して分かったRunPodの特徴と使い勝手についてまとめています。実際の使用手順について…

目的別:自分に合った手法はどれ?

| 目的 | 最適な手法 |

|---|---|

| 自分の絵柄を再現したい | LoRA / DreamBooth(高精度ならDreamBooth) |

| ポーズや構図を安定させたい | ControlNet + LoRA |

| 絵柄の変奏・別スタイルでも描きたい | LoRA + IP-Adapter or StyleAlign |

| 軽く試したい・学習環境がない | Textual Inversion + ControlNet |

| 高精度なモデルを作りたい | SDXL + LoRA or DreamBooth |

「自分の分身AIを育てる」ような作業

自分の手で、自分のアートスタイルを再現するAIを作る。

これは模倣から創造への大きな一歩になります。

「モデルの再配布」とは、自分で学習させたり微調整(ファインチューニング)したAIモデルを、他の人に配布・公開することを意味します。

たとえばこんなケースが「再配布」にあたります

- 自分の絵を学習させたAIモデルを、ネット上で無料配布する

- Hugging FaceやCivitaiなどに自作のLoRAやモデルをアップロード

- 友人にファイルを送って、生成を手伝ってもらう

- 商用サイトで販売する(「個人の絵柄で出力できるAI」など)

※学習元となった「ベースモデル」には著作権やライセンスがあり、そのルールに従わないと法的なトラブルになる可能性があります。予め著作権やライセンスを確認してください

代表的なライセンス例

| モデル名 | ライセンス | 再配布の可否 | 商用利用 |

|---|---|---|---|

| Stable Diffusion 1.5 | CreativeML OpenRAIL-M | 再配布OK(条件付き) | OK(禁止用途あり) |

| SDXL(Stable Diffusion XL) | 同上 | OK | OK |

| NovelAIモデル | 独自ライセンス(非公開) | ❌ 非公式流通はNG | ❌ 禁止されていることが多い |

| Anything V3/V4系 | 不明/非公式混合モデル | ❌ グレー | ❌ 商用危険 |

多くのモデルでは「研究・個人利用はOK、再配布や商用はライセンスに従って」とされています。

再配布するときのチェックポイント

- 元のモデルが再配布可能か?

- 商用利用もOKか?(販売や有料生成サービス)

- 使用禁止コンテンツ(暴力・ヘイトなど)があるか?

- 自分が追加したデータ(自作絵など)の権利はクリアか?

商用利用したい場合

- ベースモデルのライセンスを読む

- 公開したい場合は「条件付きで再配布OKなモデル」を選ぶ(例:Stable Diffusion 1.5)

- 商用展開なら、**自分で作った完全オリジナルモデル(学習もデータも)**を使うのが安心

「配布していいか?」は、**“どこから借りてきたものを、どこまで含んでいるか”**に大きく関係してきます。

あわせて読みたい

Hugging Face Hub(全体)と Spaces(Webアプリ)の商用利用とライセンスの見方 「AIで画像を作ってSNSやブログに使うだけだから大丈夫」と思いがちですが、実はその画像がライセンス違反になる可能性があります。商用利用NGのツールを使うリスクと、…

再配布

特に以下のような場所では、日々多くの「再配布モデル」が投稿・共有されています

- Civitai(AI画像生成モデルの共有サイト)

- Hugging Face(機械学習モデルのプラットフォーム)

- GitHub(エンジニア寄りの共有)

LoRAやファインチューニングモデルだけでなく、完成済みの画像生成モデルも出回っています。

目的別再配布

1. 「他の人にも使ってほしい」

クリエイター気質の人や、技術共有が好きな人は、自分が作ったモデルを「無償で」公開することがあります。

- 「この絵柄いいでしょ?誰でも使ってね」

- 「アニメ風モデル作ったから配布します」

- オープンソース文化に貢献したい

2. 「商品や収益にしたい」

有料で再配布・販売する人もいます。

- SkebやFANBOX、Patreonなどで支援者限定に配布

- 自作モデルを「素材」として販売(例:NFT/生成素材として)

実際、「LoRA商人」「AI絵柄屋さん」みたいな人もSNSで見かけます。

3. 「実験結果の公開」

研究者や開発者が、自分のファインチューニング結果を学術目的で共有する場合。

- 「このデータで学習させたらこうなった」

- 学会・研究用に成果としてモデルをアップ

ただし問題も…

再配布は自由にできるわけではなく、以下の問題をはらんでいます。

| 問題 | 説明 |

|---|---|

| ❌ 著作権違反 | 学習元に許可のないデータ(例:アニメ絵・ジブリ風)で作られたモデルの再配布は危険。 |

| ❌ ライセンス違反 | 元のモデルが「再配布不可」の場合、派生物でもNGになる可能性がある。 |

| ❌ クオリティ詐欺 | 「高品質」と称して、実際は他人の絵柄をコピーしただけのモデルを売る例も。 |

| ❌ 商用利用の誤解 | 再配布モデルを使って生成した画像を「自分の著作物」として売ってしまう誤用も。 |

再配布は「文化」であり「ビジネス」

- 有志の善意による「シェア文化」もあれば、

- 商業目的での販売・再利用もあり、

- 同時に「法的なリスク」もある世界です。

「自分の絵柄をAIに学ばせて、作品作りに活かしたい」というスタンスは、 今後ますます注目される**“作家自身によるAI活用”の理想形**の一つです。

もし、再配布はせずに **「個人利用」や「受注作品への活用」**を目指すなら、 かなり安全で、クリエイティブにも活かしやすい道になります。

たとえ**「自分で描いた絵」だけを使って学習したとしても、実際には完全に「ゼロ」から学習させることは現実的に非常に困難**です。

そのため、多くの場合は **すでにある“ベースモデル”**を土台にして、それに自分の絵を追加学習(=ファインチューニングやLoRA)する形になります。

「完全ゼロから」は難しい

- モデルの構造自体が巨大で、最初の段階で何十億枚もの画像で学習させる必要がある

- 必要な演算能力(GPUなど)や時間が膨大

- 単体の絵描きが自力で構築するには現実的ではない

たとえば、Stable Diffusionの基礎モデルは、LAIONというデータセット(公開画像数十億枚)から学習されています。

オリジナルに近づける方法

1. ベースモデルは信頼できるオープンなものを使う

- 例:Stable Diffusion 1.5 や SDXL(Stability AI公式)

- ライセンスを確認し、「商用利用可」や「派生モデルOK」のものを選ぶ

2. 学習させる画像は100%自作にする

- 自分で描いた線画・着彩・キャラ・背景など

- トレース・既存キャラは禁止(意図せず似てしまうのはOK)

3. ファインチューニングまたはLoRAで学習させる

- 自分のスタイルに合わせたモデルができあがる

- 再配布しない前提であれば、商用使用も安心

あわせて読みたい

【初心者向け】自作LoRAの作り方|Kohya_ssで学習する方法|Anaconda + CUDA【Windows】 ローカル環境構築から学習までを解説 この記事では、LoRAをKohya_ssで学習する為の環境構築からKohya_ssを開くまでの手順を解説しています。 LoRAモデルの概要、モデル…

法的な安心とは?

著作権法的に問題になるのは

- 他人の著作物を勝手に学習に使ったとき(例:アニメキャプ、他人の絵)

- そのモデルを商用利用 or 再配布したとき

つまり、「学習元が自分自身」で、「学習したモデルの商用使用」をするなら、最もトラブルが起きにくい安全な方法になります。

「完全オリジナルに近い状態」は作れる!

たとえば

| 項目 | 状況 |

|---|---|

| ベースモデル | SDXL(商用OK) |

| 学習データ | 自作イラスト100枚以上(線画+カラー) |

| 学習方法 | LoRA or DreamBooth |

| 使用範囲 | 自分の作品、クライアントワーク、商品制作など |

このような形であれば、**法律的にも、倫理的にも「限りなくオリジナル」**な立場で安心して使えます。

あわせて読みたい

【2026年】AI画像生成GPU おすすめ比較|RTX4060〜5090・5060Ti【Stable Diffusion・ComfyUI・LoRA対応】 画像生成AIを使いたい!GPUは何を選べばいい? Stable DiffusionやComfyUIで画像生成に挑戦したい――そう思ったとき、最初に立ちはだかる壁が「GPU選び」ではないでしょ…