AUTOMATIC1111 使い方|初心者向け完全ガイド(Stable Diffusion WebUI)

本記事は、インストールから使い方、LoRA活用、拡張機能までの

AUTOMATIC1111の各機能ページへのリンクページとなっています。

本記事は、AUTOMATIC1111の基本的な操作方法と、詳細記事へのリンクページとなっています。

AUTOMATIC1111の導入方法

基本的な操作方法

拡張機能を使用する方法

LoRA学習をする方法

については以下の記事で書いています。

目次

AUTOMATIC1111の導入方法

ローカルPCへのAutomatic1111のインストールはこちらの記事をご覧ください。

クラウドのGPUで使用する場合はこちらをご覧ください。

Controlnetや、アップスケールなどの拡張機能についてはこちらの記事をご覧ください。

LoRAモデルの使用については、こちらの記事をご覧ください。

起動方法

前提条件

Stable Diffusion WebUI(AUTOMATIC1111)を インストール済み。

もしくは、

クラウドGPU環境で、Stable Diffusion WebUI(AUTOMATIC1111)を使用できる環境がある事。

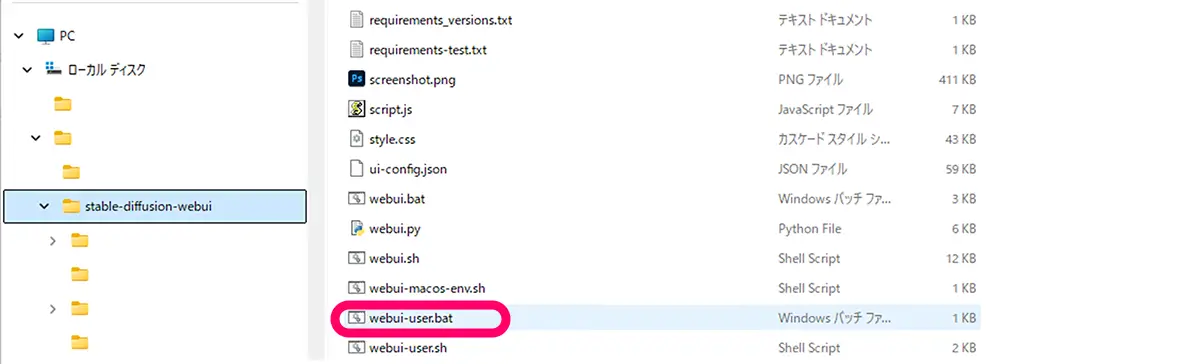

ローカルの場合(Windows)

- インストールしたフォルダ(例:

stable-diffusion-webui)を開く - 中にある

webui-user.batを ダブルクリック

⬇

ターミナル(Windows Terminal or PowerShell or コマンドプロンプト)が開いて、自動で以下が実行されます

- Pythonの仮想環境が有効化

- 必要な依存ライブラリが確認・インストール

launch.pyが呼び出されてWebUIが起動

- 起動完了後、以下のようなURLが表示される

Running on local URL: http://127.0.0.1:7860このURLをブラウザで開くとWebUIにアクセスできます 。

- インストールフォルダ内の

webui-user.batをダブルクリック - 黒いコマンドプロンプト画面が開く

- しばらく待つとブラウザが自動で立ち上がり、

http://127.0.0.1:7860が開きます

もしブラウザが開かない場合は、アドレスを手動入力してください。

クラウドGPUの場合

Deployする。

あわせて読みたい

【Runpod 】 Automatic1111テンプレート 最短セットアップ!初心者が絶対知っておくべきポイントまとめ A1111のテンプレート RunPodでAutomatic1111(Stable Diffusion WebUI)を使う際、最初につまずきやすいのが「テンプレートの選び方」と「初期設定」です。RunPod公式に…

画面構成と設定

起動すると以下のようなWebUIが表示されます。

AUTOMATIC1111 WebUI(Stable Diffusionのフロントエンド) の「基本生成設定タブ(txt2img)」

- 左側:Prompt(プロンプト入力欄)

- 下部:Negative prompt(不要な要素を指定)

- 上部タブ:

- txt2img(テキストから画像生成)

- img2img(画像から生成変換)

- Extras(アップスケーリングや顔補正)

txt2img

- Prompt に生成したい内容を英語で入力

- 例:

a cute cat, highly detailed

- 例:

- Negative prompt は空欄でもOK(不要要素がある場合のみ入力)

- Width / Height(解像度) はデフォルトでOK(512×512 または 768×768)

- Sampler は

Euler aやDPM++ 2M Karrasを選択 - 「Generate」をクリック

右側にプレビューが表示されれば成功です。

もっと自分好みのキャラクターやスタイルを反映させたい方は、 LoRA(学習済み追加モデル) を使うと便利です。

AUTOMATIC1111ではLoRAも簡単に読み込んで使えます。

詳しい手順はこちらをご覧ください[AUTOMATIC1111でLoRAモデルを使う方法]

img2img

テキストだけでなく「画像をもとに別の画像を生成」する機能が img2img です。

詳しい解説はこちらをご覧ください。

[AUTOMATIC1111 img2imgの使い方(リンク)]

あわせて読みたい

AUTOMATIC1111【img2img】の使い方 AUTOMATIC1111【img2img】の設定項目の使い方 気に入った生成画像をベースに、AUTOMATIC1111のimg2imgで似た画像を生成するためには、以下のポイントを意識すると効果的…

Extras

Extraタブ内の画像修復とアップスケールの使用方法はこちらの記事でまとめています。

あわせて読みたい

Automatic1111での画像の修復とアップスケールをする方法 A1111での顔画像と画像全体の修復、アップスケールの方法 GFPGAN(顔修復・補正モデル) — GitHubリポジトリ: https://github.com/TencentARC/GFPGAN GitHub CodeFormer…

LoRAモデルの使い方

あわせて読みたい

【完全ガイド】Stable Diffusion WebUI(AUTOMATIC1111) LoRA モデルの使い方と設定手順 この記事では、Stable Diffusion WebUI(AUTOMATIC1111)での、”LoRAモデルの配置方法から、強度の設定・プロンプト調整までを、わかりやすく解説しています”Stable Dif…

生成した画像の保存場所

生成された画像は自動でPCに保存されます。

保存先:stable-diffusion-webui/outputs/txt2img-images/日付フォルダ/

画像の下にある「Save」ボタン、もしくはダウンロードボタン、画像を保存から手動保存も可能です。

AUTOMATIC1111の主要設定項目

Sampling method(サンプリング方式)

画像を「ノイズから復元」していくアルゴリズムの種類の選択。

- Euler a … 初期設定でよく使われる高速・安定タイプ。

シャープで、アニメ調にも向いています。 - 他にも

- DPM++ 2M Karras(高品質・安定)

- DPM++ SDE Karras(柔らかい質感)

- DPM++ 3M SDE(高品質・安定)

- DDIM(旧来のSD1.5系の標準)などがあります。

コツ:

SDXLモデルなら「DPM++ 2M Karras」や「DPM++ 3M SDE」系が安定的に高品質です

Schedule type(スケジュールタイプ)

サンプリングアルゴリズム内で、ノイズ除去の進行具合(スケジュール)を決める設定。

「Automatic」はモデルに最適なスケジュールを自動選択するモード。

特にこだわりがなければこのままでOK。

Sampling steps(サンプリングステップ数)

生成に使う反復回数。

数値が多いほど時間がかかるが、細部が整いやすい。

- 例:

- 20〜25:スピード重視(十分高品質)

- 30〜40:高精細だが生成時間が長くなる

- LoRAやControlNetを使う場合は25〜30がバランス◎

Hires. fix(高解像度修正)

生成した画像をさらに高解像度にしたい場合は、Hires.fix 機能を使います。

- txt2imgタブの中にある「Hires.fix」にチェックを入れる

- Upscale by(倍率) を「2」程度に設定

- 「Generate」をクリック

これで1回目の生成画像をもとに、自動で高解像度版を生成してくれます。

Refiner(リファイナー)

SDXL専用の「仕上げモデル」。

- 例:

sdxl_refiner_1.0.safetensors - 生成途中の画像を再度ブラッシュアップしてくれる。

- ADetailerとは別で、テクスチャや質感を向上させます。

SDXL系では「Refinerあり」が標準的です。

Width / Height(画像サイズ)

出力解像度(ピクセル単位)。

- 512×512:標準的。SD1.5では推奨。

- 1024×1024:SDXLの推奨解像度。

- サイズが大きいほどVRAMを多く消費します。

Batch count / Batch size

一度に何枚生成するかの設定。

- Batch count:連続生成回数(何ターン回すか)

- Batch size:1ターンで同時に生成する枚数

例)

Batch count 2 × Batch size 2 → 合計4枚生成。

Batch sizeを増やすとVRAM負荷が増します。

CFG Scale(ガイダンススケール)

「プロンプトにどれだけ忠実に従うか」を決める値。

- 7が標準的(安定)

- 低い(3〜5) → 自然でランダムな結果

- 高い(10〜12) → プロンプトに忠実だが破綻しやすい

一般的には「6〜8」で使われます。

Seed(シード値)

ノイズの初期状態。

同じSeed+同じ設定なら、同じ画像が再現できます。

- -1:ランダム生成

- 任意の数値(例:12345)を指定すると、再現性のある生成

ボタンでランダム化、♻️ で前回Seedの再使用が可能。

おすすめ初期値

| 項目 | 推奨設定(SDXL向け) |

|---|---|

| Sampling method | DPM++ 2M Karras |

| Sampling steps | 25〜30 |

| CFG Scale | 7 |

| Width / Height | 1024×1024 |

| Hires. fix | ON(倍率1.5〜2.0) |

| Refiner | SDXL Refinerを使用 |

| Seed | -1(ランダム) |

| Batch count | 2〜4(比較生成) |

追加機能

A1111 に含まれている非StableDiffusion系の機能・モデル

A1111 はこういう構造になっています

Stable Diffusion(本体)

↑

追加プラグイン・外部モデル

├ GFPGAN

├ RestoreFormer

├ Real-ESRGAN

├ SwinIR

├ CodeFormer

├ Booru tagger

├ CLIP interrogator

└ ControlNetA1111 にある機能の多くは SD ではなく、外部AIモデルや補助ツール です。

GFPGAN(顔補正)

RestoreFormer / CodeFormer(顔修復)

ESRGAN / Real-ESRGAN(アップスケーラー)

LDSR / SwinIR / 4xUltraSharp

ControlNet

ADetailer

Dynamic Thresholding (CFG Scale Fix)

ReActor

Script(スクリプト)

よくあるトラブルと対処法

モデルが見つからないエラー

→ /models/Stable-diffusion/ フォルダにベースモデル(例:SD1.5やSDXL)を配置してください。

VRAM不足エラー

→ 起動オプションに --medvram または --lowvram を追加すると改善する場合があります。

もしVRAM不足でエラーが出てしまう場合は、まず以下を試してみてください。

- 画像サイズを小さめにする(例:512×512)

- 軽量なモデル(SD 1.5など)を使う

- バッチサイズを1にする

それでも解決しない場合や、高解像度や高精細な画像が生成したい場合は、

クラウドGPUサービスを利用するのがおすすめです。

[RunPodの使い方解説記事] では、SDXLのような重いモデルでも快適に生成出来る”AUTOMATIC1111をクラウド環境で動かす方法”について書いています。

又、最新のFluxモデルをワンクリックで使用できるテンプレートや、画像から動画を生成するテンプレートについても紹介しています。

ブラウザが開かない

→ http://127.0.0.1:7860 を手動で入力

まとめ

- AUTOMATIC1111は まずtxt2imgで1枚生成するところから 始めるのがおすすめ

- Hires.fixを覚えると高画質化が可能

- img2imgやLoRAを使えばさらに表現の幅が広がります