Real-ESRGAN と GFPGANを連携させる方法とGUIで使えるツール

Real-ESRGAN と GFPGAN

Real-ESRGAN(リアル・イーエスアールガン)と GFPGAN (ジーエフピーガン)は、インストール手順や使い方が、かなり似ています。

両方とも Tencent ARC によって開発されており、基本的な実行構成が似ているからです。

本記事では、GUIでReal-ESRGAN と GFPGANを使えるツールについてと、ローカルでReal-ESRGAN と GFPGANを連携させる方法(導入までの手順を含む)を書いています。

目次

主なGFPGANモデル

GFPGANの顔復元(Face Restoration)専用モデルは、バージョンや学習条件によって複数のモデルファイルがあります。

※Automatic1111や、ComfyUIで使用する場合は、前もってダウンロードをする必要はありません。

| モデル名 | 特徴 | ファイル例 |

|---|---|---|

| GFPGANv1.4 | 現時点で最も安定し、自然で破綻の少ない顔復元。背景も無難に処理。 | GFPGANv1.4.pth |

| GFPGANv1.3 | 1.4よりシャープで、顔の線を強調しやすい。やや人工的になる場合あり。 | GFPGANv1.3.pth |

| GFPGANv1.2 | 初期版に近い描画。レトロ写真や低解像度写真の復元が得意。 | GFPGANv1.2.pth |

| GFPGANv1.0 | 初期モデル。アニメ顔など特殊用途での試験に使われることがある。 | GFPGANv1.pth |

- 1.4 → 現行の標準。自然な顔補正で、多くの用途に無難に使える。

- 1.3 → よりシャープ&メリハリある仕上げ。ただし少し不自然な場合も。

- 1.2 → 古い写真やぼやけ画像の補修に有効。

- 1.0 → 実験的用途。

公式リポジトリ(TencentARC/GFPGAN)

- https://github.com/TencentARC/GFPGAN

Releasesページに.pthモデルが公開されています。 - 配置場所(単体実行時)

experiments/pretrained_models/フォルダ内に置く。

あわせて読みたい

【GFPGANのインストール方法と使い方】と【Automatic1111で使用する方法】 GFPGANとは? GFPGAN(Generative Facial Prior GAN)は、顔画像に特化した、顔復元のためのツールです。リアルな仕上がりで古い写真の再生に最適なツールです。顔以外の…

主な Real-ESRGAN モデル

- RealESRGAN_x4plus:汎用写真・イラスト向け。×4 アップスケーリングが可能。

- RealESRGAN_x4plus_anime_6B:アニメ/イラストに特化した最新モデルで、線のディテールと色面をきれいに再現。

- RealESRGAN_x2plus:低倍率(×2)向け。自然な拡大が可能で、特に微細なディテールを維持したい場合におすすめ。

(※ GitHub Releases ページで直接 .pth モデルファイルが並んでいます)

公式リポジトリ(Animesrgan/Real-ESRGAN)

- GitHub: https://github.com/xinntao/Real-ESRGAN/releases

- Release ページの「.pth」または「.onnx」ファイルをダウンロードし、

stable-diffusion-webui/models/ESRGAN/フォルダにモデルファイルを保存すると、WebUI画面から選択可能になります。

使用方法3通り

方法は、大きく分けて三通りです。

| 方法 | ツール例 | 特徴 | 推奨ユーザー |

|---|---|---|---|

| ①専用アプリ(簡易GUI型) | Upscayl, GFPGAN GUI | 環境構築不要で手軽、初心者向け | 初心者 |

| ②WebUI(統合型) | AUTOMATIC1111, ComfyUI, Forge | GUI操作で安定。Stable Diffusionと連携可 | 初心者〜中級者 |

| ③公式リポジトリ(コマンドライン型) | Real-ESRGAN/GFPGAN GitHub | Python実行。実験・バッチ処理向け | 上級者・研究者 |

①専用アプリから使う(簡易GUI型ローカルアプリ(ダウンロードして使うソフト))

特徴

- 無料版はオープンソース、広告なし

- 基本的なアップスケールやモデル選択が可能

- 有料版は追加機能や優先アップデートあり

メリット

- 環境構築不要ですぐ使える

- GFPGAN GUIも同様

UpscaylとGFPGAN GUIは、事前に環境を用意しなくてもすぐ使えます。

Upscayl

【Upscaylのダウンロードと使い方】アップスケーラーを使って画像を簡単に高画質化する方法 Upscayl/Real-ESRGANの使い方 本記事では、Upscaylを使って簡単に画像を高解像度化する方法についてて解説しています。 Upscaylとは Upscaylとは既存の高性能モデル(…

②WebUI(統合型)おすすめです

Web UI系ツール とは、「コードを書かずに、画面上のボタンやメニューで操作できるツールです。

Pythonなどの知識も必要ありませんが、ツールによっては、一旦使用するファイルをダウンロードしてからクラウド上で操作します。

※Automatic1111や、ComfyUIなどをインストールする必要があります。

定期的に使用したい場合や、他の機能とも併用できるというメリットがあります。

AUTOMATIC1111などを、RunPodなどのクラウドGPUを用いた実行環境で使用する場合

クラウド上の高性能GPUを使用して生成が行えるため、生成を高速化できます。

**レンタルクラウドGPU(Runpod)では、ワンクリックで、Real-ESRGANやGFPGANが統合されているAutomatic1111や、ComfyUIを使用できるテンプレートもあります。

Runpodの使用方法はこちらで解説しています。https://sakasaai.com/runpodstadiff00/

多少事前の準備(アカウント作成、ストレージの作成)が必要ですが、ツール自体はワンクリックで立ち上げて使用できます。

Python, Git, CUDA環境なども必要無いので、一度準備してしまえばとても快適です。

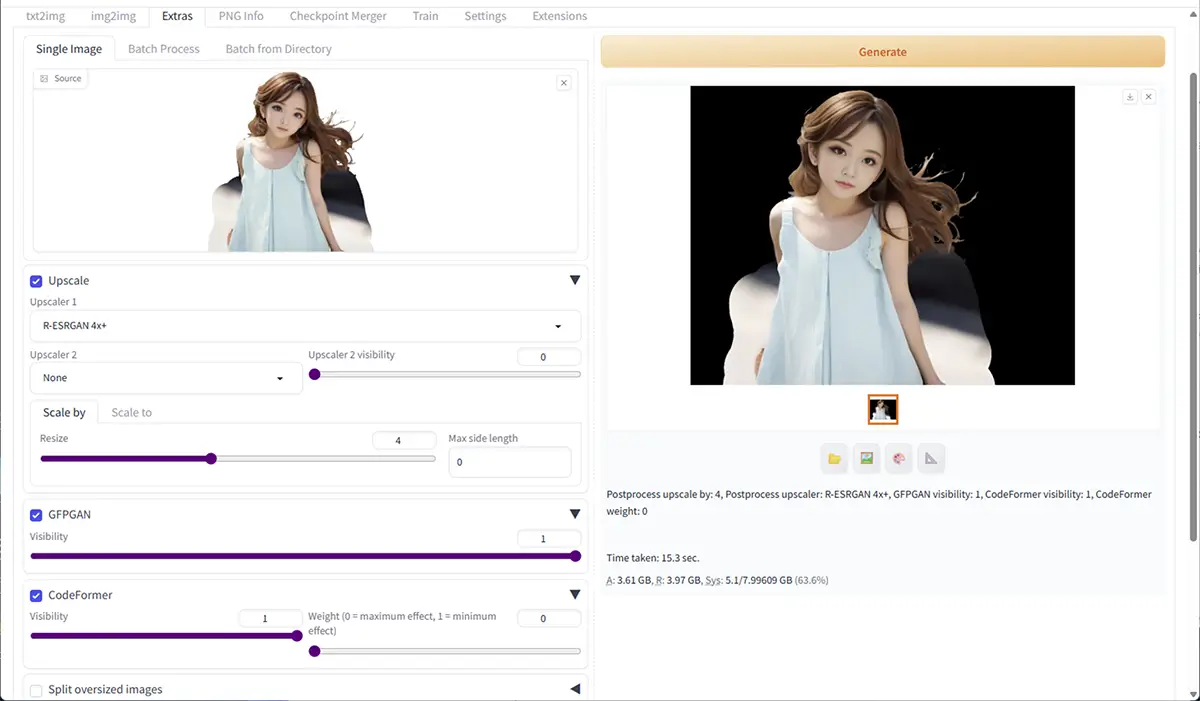

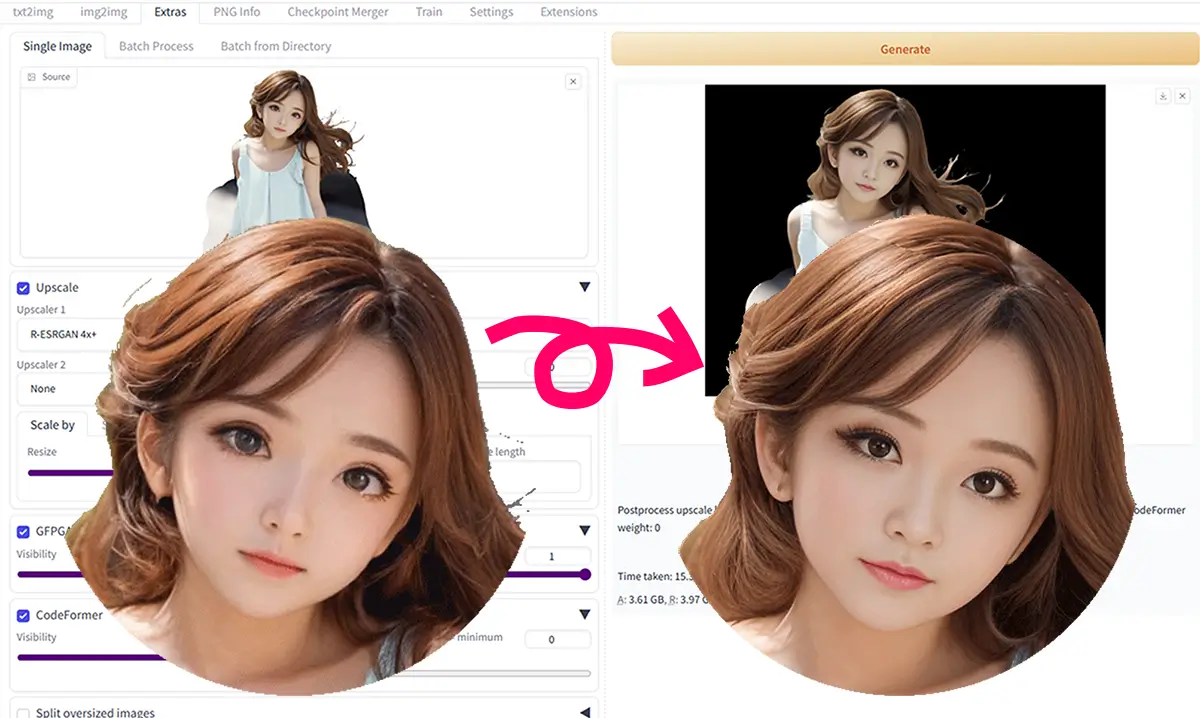

AUTOMATIC1111

この方法は、AUTOMATIC1111(通称 A1111 の Stable Diffusion WebUI)を自分のPCにインストールして(もしくは、クラウド環境のレンタルGPUを借りて)使用します。AUTOMATIC1111は、Extras タブを介して以下の 2 つの高度な画像処理ツールを統合しています。

インストール方法はこちらで解説しています

WebUI(AUTOMATIC1111)の【インストール方法】【拡張機能インストール】【エラー対処法】 WebUI(Webユーザーインターフェース)とは、ブラウザを通じて操作できるユーザーインターフェースのことです。特にStable Diffusionでは、WebUIを使うことで専門的なコ…

難易度:低 / おすすめ:◎

特徴

Extrasタブに Real-ESRGAN / GFPGAN 統合

インストールは launch.py 実行で自動または手動

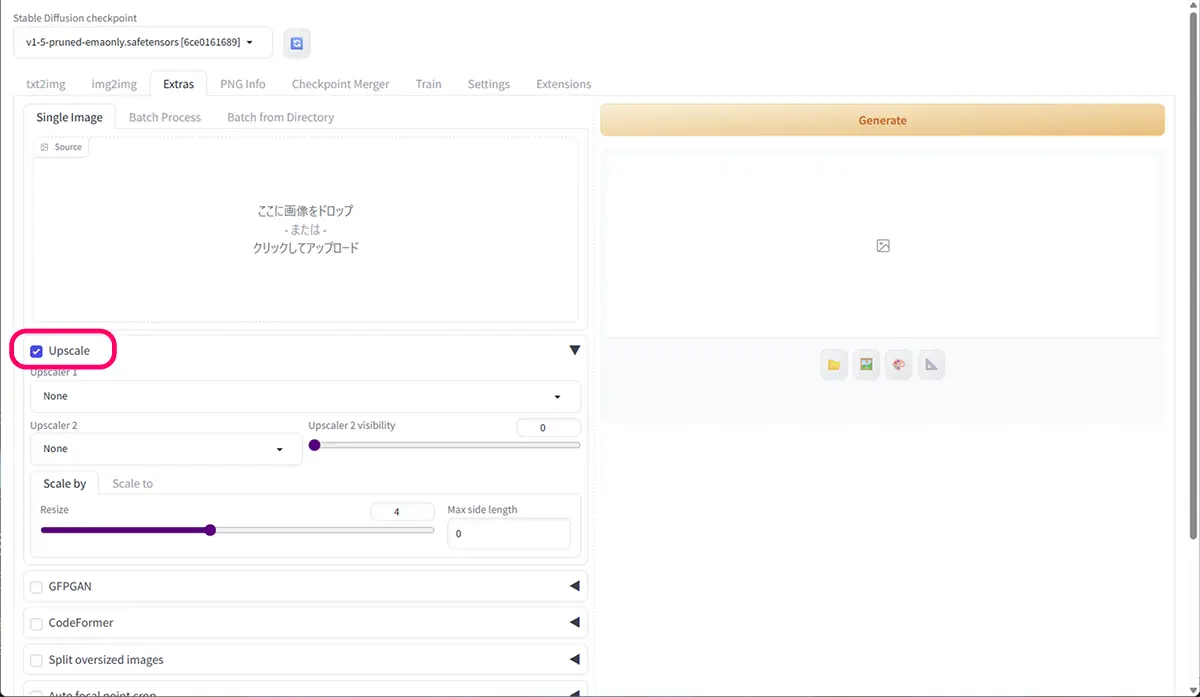

使い方の流れ(A1111 Web UI)

- モデルの準備

- Real‑ESRGAN モデルファイルを

models/ESRGAN/フォルダに配置。 - GFPGAN モデルは所定のフォルダに配置すれば Extras タブで自動検出されます。

- Real‑ESRGAN モデルファイルを

- WebUI を起動

通常webui.pyを実行して起動します。起動後、上部のメニューバーから Extras タブを選択。

- Extras タブの操作

- 「Upscale: Real‑ESRGAN」 のセクションで解像度拡大のパラメータ(倍率、モデル選択 等)を選択。

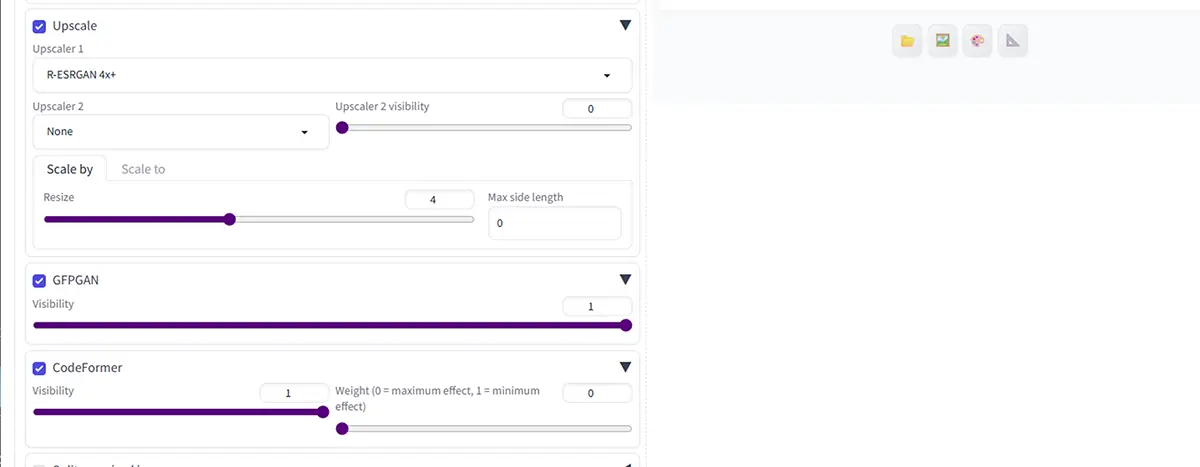

Extrasタブの主な設定項目

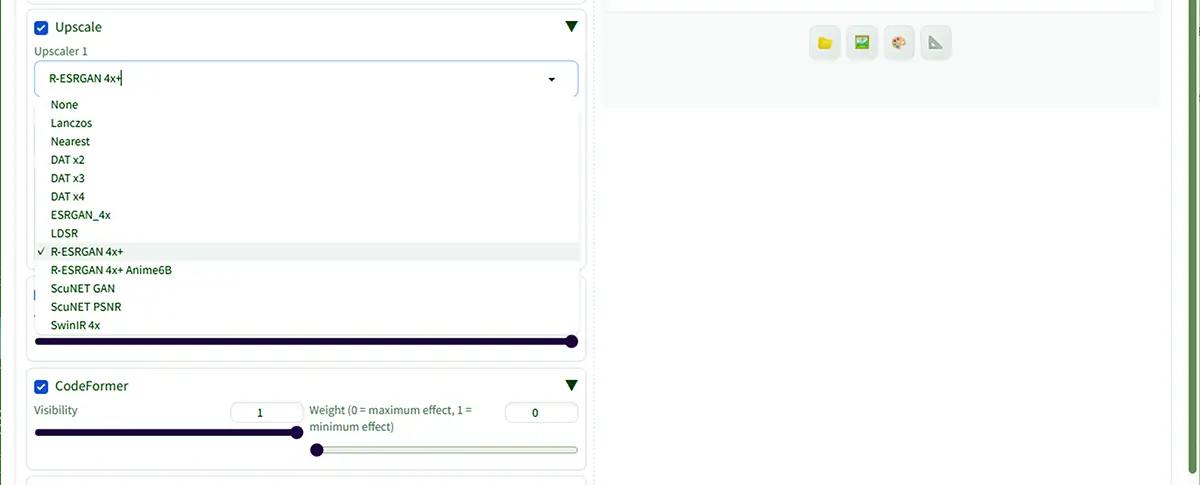

- Upscaler 1 / Upscaler 2

- ここで

Real-ESRGAN_x4plusなどを選択します。 Upscaler 2はオプションで、組み合わせる場合に使います(例えば、一次処理にESRGAN、二次処理にLanczosなど)。- ふつうは Upscaler 1にReal-ESRGAN を選べばOKです。

- ここで

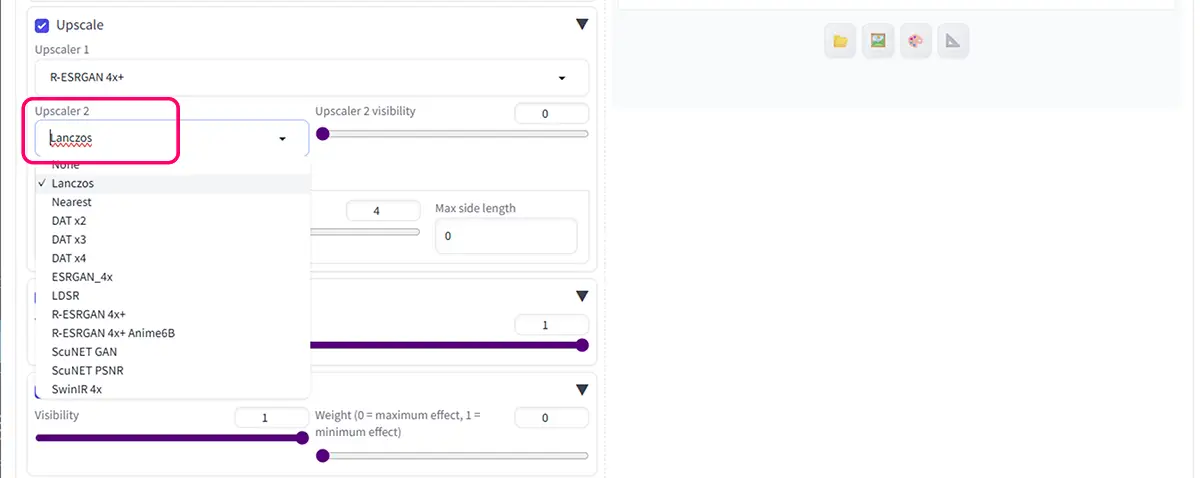

- Upscaler 2 visibility

- 0〜1でブレンド率を決められます。

0ならUpscaler 1のみ、1ならUpscaler 2のみ、0.5なら両方半々。

- Scale by

- 倍率指定(例:2、4など)。

Scale by 4なら縦横ともに4倍になります。

- Scale to / Resize

- ピクセル数で直接指定したいときに使います。

- 例えば「Scale to 2048」で一辺を2048pxに揃える。

- Max side length

- 画像の一番長い辺の上限を設定。

- 0にすると無制限(そのまま倍率通り)。

- VRAM不足対策で縮小される場合に役立ちます。

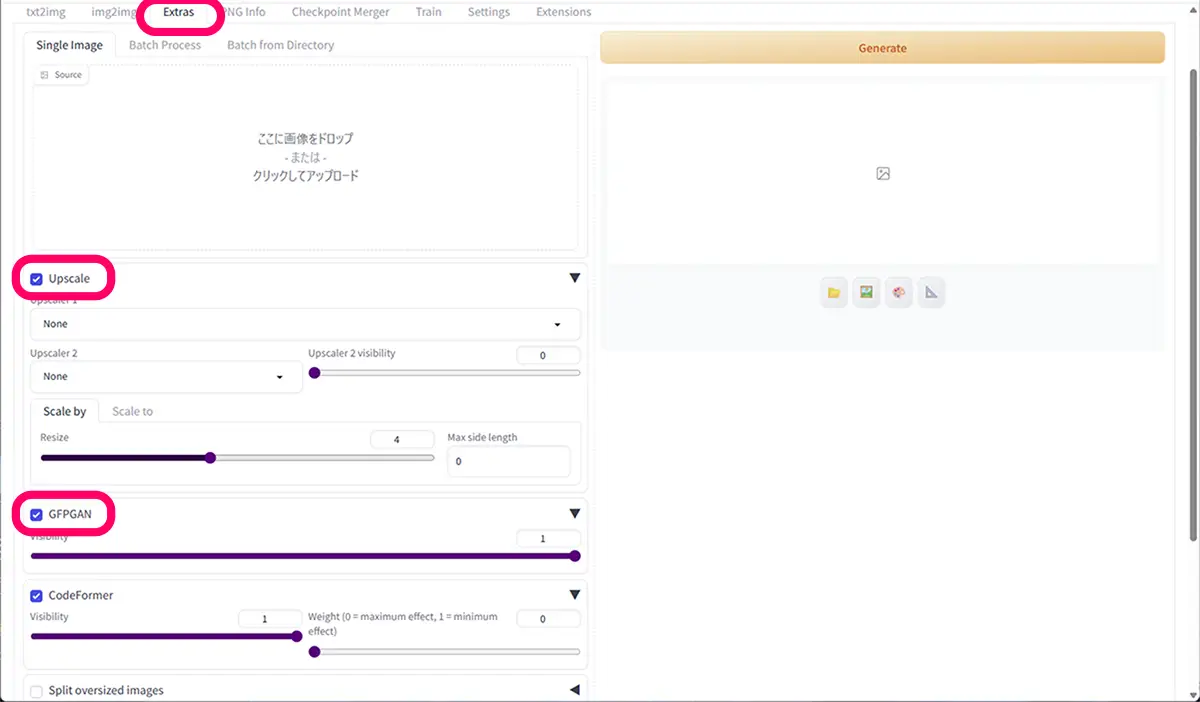

- 「Face Restore: GFPGAN」 のセクションから顔修復用モデルを選択。

GFPGAN(顔補正)

- Visibility

- 顔補正の強さ。

- 1 → フル適用

- 0.5 → 半分だけ適用

- 0 → 無効

CodeFormer(顔補正の別手法)

- Visibility

- GFPGANと同じく、強さの調整。

- Weight (0 = maximum effect, 1 = minimum effect)

- 効果のかかり具合をコントロール。

0→ 効果最大(かなり修正される)1→ 効果最小(ほぼ元画像のまま)

顔がある画像 → GFPGANやCodeFormerをON

背景や全体の解像度強化 → Real-ESRGANをメインに

GFPGANとCodeFormerは同時に使えますが、仕上がりは好みによるので片方だけで十分な場合も多い。

- 必要に応じて出力画像名、保存先などを設定して「Run」をクリック。

あわせて読みたい

Automatic1111での画像の修復とアップスケールをする方法 A1111での顔画像と画像全体の修復、アップスケールの方法 GFPGAN(顔修復・補正モデル) — GitHubリポジトリ: https://github.com/TencentARC/GFPGAN GitHub CodeFormer…

ComfyUI

- ノードで Real-ESRGAN / GFPGAN を組み込み可能

- Stable Diffusion 生成後に処理を連携させることも簡単

あわせて読みたい

ComfyUIとは?Stable Diffusion 各モデルの特徴・用途・対応ツールのインストールと使い方 ComfyUIの使い方 Stable Diffusionの代表的WebUI「AUTOMATIC1111」に続き、InvokeAIやForgeも人気が急上昇。しかし、最も高機能なツールとして注目されるのは、自由自在…

③公式リポジトリから直接使う(コマンドライン型)

前提環境

- Python(3.7~3.10推奨)Python3.10.6のインストール方法についてはこちらの記事をご覧下さい

- GitGitのインストール手順についてはこちらの記事をご覧下さい

- CUDA(NVIDIA GPUがある場合)

- PyTorch(バージョンはCUDAに合わせる)Pythonで画像生成を始める方法について

Real-ESRGAN や GFPGAN は PyTorch や特定のバージョンのライブラリに依存しているため、専用の仮想環境を作ることで他のプロジェクトと干渉しません。

その為、CUDA環境の構築が楽で、PyTorch + GPU(CUDA)のセットアップが conda で簡単にできるAnaconda(またはMiniconda)の使用がおすすめです。

| 比較項目 | venv(Python標準) | Anaconda(またはMiniconda) |

|---|---|---|

| 環境構築の簡単さ | 自分でPython・CUDA・PyTorchのバージョン整合をとる必要あり | condaが自動で依存関係を解決 |

| パッケージの管理 | 基本はpip頼り。複雑な依存関係で詰まりやすい | conda + pip両方使えて柔軟&強力 |

| CUDAの扱い | CUDA Toolkitを手動インストールしてパス設定が必要 | PyTorch+CUDAをconda install pytorchだけで完結できることが多い |

| 初心者への安心感 | エラー時の自己解決力が必要 | 失敗しにくい構成。エラーも少ない |

| 仮想環境の切り替え | source venv/bin/activate など | conda activate 環境名 で統一 |

※Anacondaを使用する場合は、CUDAとPyTorchのインストールを個別で行う必要がありません。

ここでは、

1⃣Anacondaをインストールして環境を構築する方法と、

2⃣ CUDAとPyTorchのインストールをして環境を構築する方法

という二通りにの環境構築方法について書いています。

1⃣Anacondaをインストールして環境を構築する方法

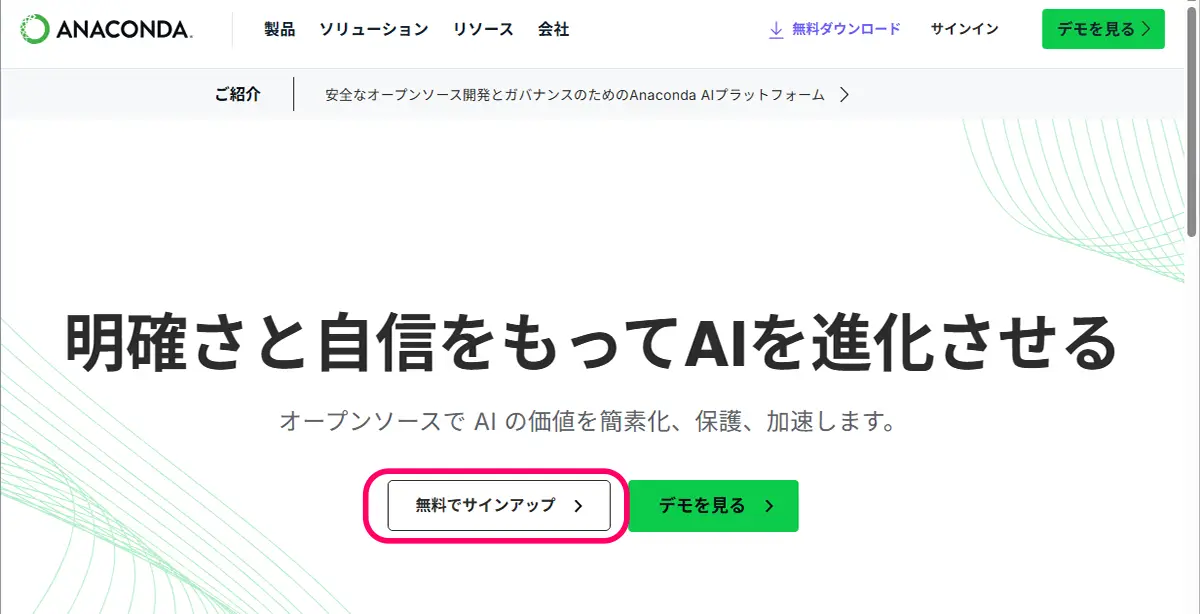

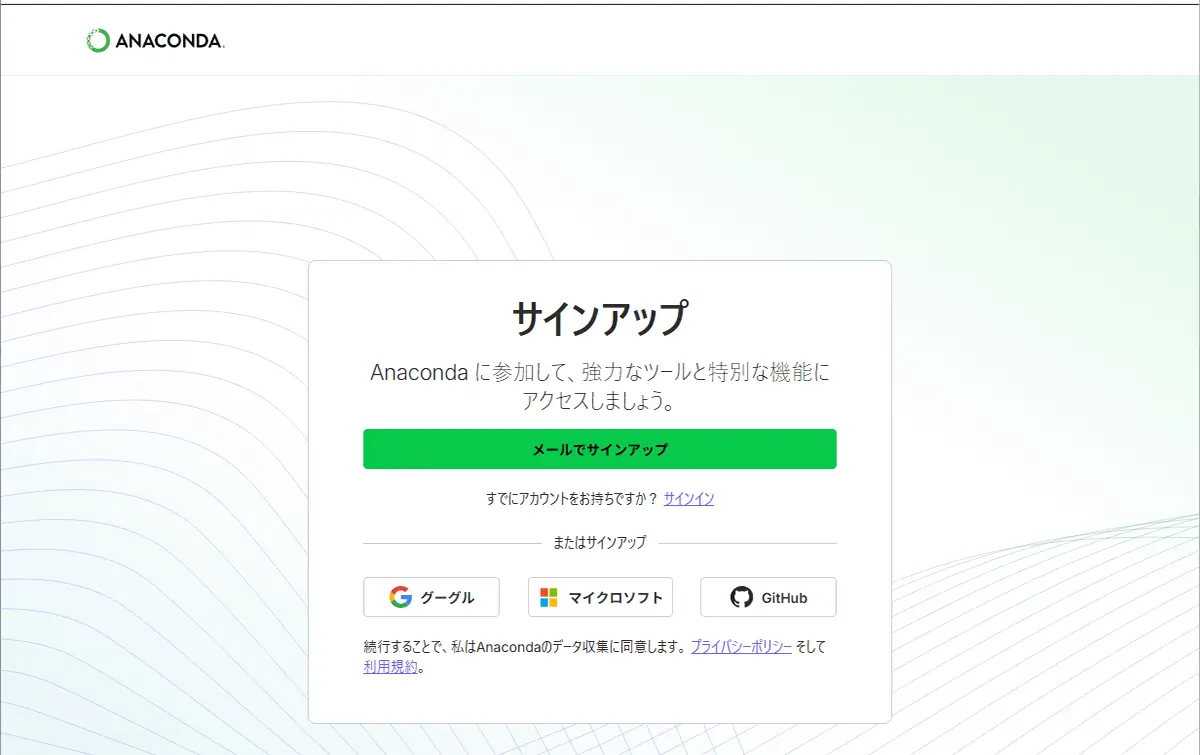

Anacondaのインストール

- 公式ダウンロードページ: anaconda.com

任意のアカウントでログインします。

Anacondaの公式ダウンロードページから、お使いのOSに対応したインストーラーをダウンロードできます。

① Anacondaの準備

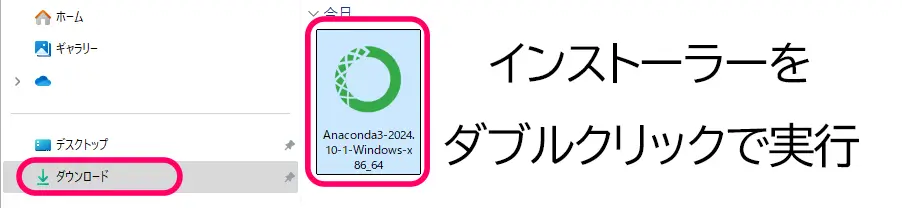

インストール手順(Windowsの場合)

- ダウンロードしたインストーラー(例:

Anaconda3-2024.10-1-Windows-x86_64.exe)をダブルクリックして実行します。

2. インストーラーが起動したら、「Next」をクリックします。

3. ライセンス契約画面で「I Agree」を選択します。

4. インストールタイプの選択では、「Just Me(推奨)」を選び、「Next」をクリックします。

5. インストール先フォルダを確認し、必要に応じて変更後、「Next」をクリックします。

6. 追加タスクの選択では、特に変更がなければそのまま「Install」をクリックします。

7. インストールが完了したら、「Next」をクリックし、最後に「Finish」をクリックしてインストールを終了します。

インストール後、スタートメニューから「Anaconda Prompt」や「Anaconda Navigator」を起動できます。

※Anaconda Navigator(GUI)からアップデートを求められた場合は、基本的にはそのまま「更新」してOKです。ただし、すでに構築済みの仮想環境内でパッケージを更新する場合は、conda updateやpipのバージョン管理に注意が必要です。

インストール確認

Anaconda Promptを開き、以下のコマンドを入力してPythonのバージョンを確認します。

Anaconda Promptは、WindowsでAnacondaをインストールした後、以下の手順で起動できます。

- スタートメニューを開く

- 「Anaconda Prompt」と検索

- アイコンをクリックして起動

※黒いウィンドウが開き、(base) と表示されていれば、Anacondaの「base」環境が有効になっています。

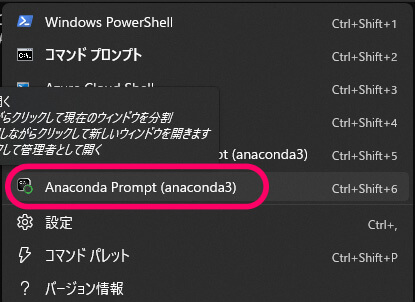

もしくは、Windowsターミナルを開き、

タブから””下矢印をクリックで、Anaconda Promptを選択(Anacondaインストール後に追加されます。)

※ Windows のターミナルの起動方法…

Windows Terminal起動方法

- スタートメニューで、左クリック➡

ターミナルもしくは、「Windows Terminal」と検索して起動

※ デフォルトでは PowerShell または WindowsPowerShell)が開きます

画像生成用途の場合は、コマンドプロンプト(CMD)と相性が良いです。

pip install や conda などのモダン開発向けコマンドは、PowerShellと相性が良いです。

(※コマンドプロンプト(cmd)をWindows Terminal から開く為の設定方法はこちらの記事をご覧ください。)

Windows Terminalは、タブを切り替えて複数のシェルを使う事が出来ます

- 上部の

+ボタンから新しいタブを開けます

※Microsoft 公式も「Windows Terminal」を推奨

※ Mac のターミナルの起動方法…

ターミナル起動方法

- **「Command ⌘ + Space」を押して、「Spotlight検索」**を開く

- 検索バーに「ターミナル」と入力してEnter

または、以下の手順でも開けます:

アプリケーション → ユーティリティ → ターミナル

※ Linux のターミナルの起動方法…

Linuxターミナル起動方法

- 1,:

Ctrl + Alt + Tを同時に押す(多くのLinuxディストリビューションで共通) - 2,:アプリケーション一覧から「ターミナル」または「Terminal」で検索して開く

Ubuntu、Fedora、Debianなど、ほとんどのLinux環境に標準で搭載されています。

※ PowerShell の起動方法…(Windows)

PowerShell(パワーシェル)**は、Windowsに標準搭載されている、より高度な操作ができるコマンドラインツールです。見た目はコマンドプロンプトと似ていますが、より多機能で、プログラミング的な処理も得意です。

PowerShell起動方法

1,スタートメニューで「PowerShell」と検索してクリック

※ コマンドプロンプト(cmd)の起動方法…(Windows)

Windowsキー + Rを押す

「cmd」と入力してEnterを押す

または、スタートメニューで「コマンドプロンプト」と検索してもOK!

コマンドプロンプト(cmd)は、Windowsのターミナルからも開く事が出来ます

(※コマンドプロンプト(cmd)をWindows Terminal から開く為の設定方法はこちらの記事をご覧ください。)

python --versionまた、Anaconda Navigatorを起動して、GUI上で環境やパッケージの管理ができることを確認してください。

Anaconda Prompt を開いて以下を実行(仮想環境を有効化)

conda create -n realesrgan_env python=3.10

conda activate realesrgan_env※このコマンドを実行する事で、realesrgan 内で仮想環境を使った作業ができる状態になります。

PyTorch(GPU対応)をインストール(※GPUを使う場合。CPU版でもOK)

# 例:CUDA 11.8 対応の場合

conda install pytorch torchvision torchaudio pytorch-cuda=11.8 -c pytorch -c nvidia2⃣ CUDAとPyTorchのインストール

Real-ESRGANやGFPGANをGPUで高速に動かすには、**CUDA(NVIDIAのGPU用ドライバ)と、それに対応するPyTorch(機械学習ライブラリ)**を正しくインストールする必要があります。

先ずは、その手順から見ていきたいと思います。

1. お使いのGPUがCUDA対応か確認する

まず、ご自身のPCに搭載されているNVIDIA製GPUがCUDAに対応しているかどうか?を確認します。確認方法については、こちらの記事の冒頭で書いていますので、ご確認ください。

SAKASA AI

ローカルCLI(Pythonスクリプト)の為の【PyTorch+CUDA】のインストール手順 | SAKASA AI PyTorch + CUDA のインストール GPUとCUDAの互換性を確認する方法 PyTorch・Stable Diffusion・ComfyUI など、GPUを使うAIツールを動かすときは「GPUがCUDAに対応している…

2. NVIDIA GPUドライバとCUDA Toolkitのインストール

GPUを活用するには、以下の2つが必要です。

- GPUドライバ:NVIDIA公式サイトからダウンロード(既に最新版ならOK)

- *CUDA Toolkit:PyTorchのバージョンに合わせたものをインストール

*ただし、特別な事情がない限り「PyTorchだけ入れればOK」です。PyTorchのインストール時に、自動的に対応したCUDAランタイムが入るため、CUDA Toolkitを直接インストールする必要はありません。

CUDA + PyTorchについての詳しい解説とインストール手順については、こちらの記事をご覧ください。

SAKASA AI

ローカルCLI(Pythonスクリプト)の為の【PyTorch+CUDA】のインストール手順 | SAKASA AI PyTorch + CUDA のインストール GPUとCUDAの互換性を確認する方法 PyTorch・Stable Diffusion・ComfyUI など、GPUを使うAIツールを動かすときは「GPUがCUDAに対応している…

Real-ESRGANとGFPGANの共通点(インストール・使い方)

インストール手順(共通)

git clone https://github.com/TencentARC/Real-ESRGAN.git # または GFPGAN に差し替え

cd Real-ESRGAN

pip install -r requirements.txt

python setup.py develop推論コマンドの例(コマンドラインからの実行)

# Real-ESRGAN の場合(画像の高画質化)

python inference_realesrgan.py -n RealESRGAN_x4plus -i inputs

# GFPGAN の場合(顔の修復)

python inference_gfpgan.py -i inputs --face_enhance違い(中身と出力)

| 項目 | Real-ESRGAN | GFPGAN |

|---|---|---|

| 主な目的 | 画像全体の超解像(高画質化) | 顔画像の復元・修復 |

| 入力画像の種類 | 写真やイラスト全般 | 顔が写っている画像 |

| 出力 | 全体を滑らか&高精細にアップスケーリング | 顔部分を整えて自然な状態に修復 |

| モデル名例 | RealESRGAN_x4plus | GFPGANv1.3.pth(face_enhanceあり) |

GFPGANとReal-ESRGANを連携させる方法

AUTOMATIC1111 などの WebUI を使わずに、GFPGAN と Real-ESRGAN をローカルで連携させて使う方法。

「GFPGANで顔補正 → Real-ESRGANでアップスケーリング」という順番でスクリプトを組む方法

1. 環境準備

Python と依存パッケージ

pip install basicsr facexlib realesrgan gfpgan- basicsr と facexlib は両方のツールが共通で使う画像処理ライブラリです。

realesrganとgfpganはそれぞれの実装。

2. モデルファイルの準備

- GFPGAN

- 公式リポジトリ: https://github.com/TencentARC/GFPGAN

- 例:

GFPGANv1.4.pth(または最新)をexperiments/pretrained_models/に置く。

- Real-ESRGAN

- 公式リポジトリ: https://github.com/xinntao/Real-ESRGAN

- 例:

RealESRGAN_x4plus.pthをexperiments/pretrained_models/に置く。

に関する詳細については、こちらをクリックしてください。

主なGFPGANモデル

GFPGANの顔復元(Face Restoration)専用モデルは、バージョンや学習条件によって複数のモデルファイルが存在します。

| モデル名 | 特徴 | ファイル例 |

|---|---|---|

| GFPGANv1.4 | 現時点で最も安定し、自然で破綻の少ない顔復元。背景も無難に処理。 | GFPGANv1.4.pth |

| GFPGANv1.3 | 1.4よりシャープで、顔の線を強調しやすい。やや人工的になる場合あり。 | GFPGANv1.3.pth |

| GFPGANv1.2 | 初期版に近い描画。レトロ写真や低解像度写真の復元が得意。 | GFPGANv1.2.pth |

| GFPGANv1.0 | 初期モデル。アニメ顔など特殊用途での試験に使われることがある。 | GFPGANv1.pth |

- 1.4 → 現行の標準。自然な顔補正で、多くの用途に無難に使える。

- 1.3 → よりシャープ&メリハリある仕上げ。ただし少し不自然な場合も。

- 1.2 → 古い写真やぼやけ画像の補修に有効。

- 1.0 → 実験的用途。

公式リポジトリ(TencentARC/GFPGAN)

- https://github.com/TencentARC/GFPGAN

Releasesページに.pthモデルが公開されています。 - 配置場所(単体実行時)

experiments/pretrained_models/フォルダ内に置く。

主な Real-ESRGAN モデル

- RealESRGAN_x4plus:汎用写真・イラスト向け。×4 アップスケーリングが可能。

- RealESRGAN_x4plus_anime_6B:アニメ/イラストに特化した最新モデルで、線のディテールと色面をきれいに再現。

- RealESRGAN_x2plus:低倍率(×2)向け。自然な拡大が可能で、特に微細なディテールを維持したい場合におすすめ。

(※ GitHub Releases ページで直接 .pth モデルファイルが並んでいます)

公式リポジトリ(Animesrgan/Real-ESRGAN)

- GitHub: https://github.com/xinntao/Real-ESRGAN/releases

- Release ページの「.pth」または「.onnx」ファイルをダウンロードし、

stable-diffusion-webui/models/ESRGAN/フォルダにモデルファイルを保存すると、WebUI画面から選択可能になります。

3. 連携処理の流れ(例)

以下は Pythonスクリプト例 です。

GFPGANで顔補正した画像を、そのまま Real-ESRGAN に渡して高解像度化します。

<!-- wp:preformatted -->

<pre class="wp-block-preformatted">pythonコードをコピーする<code>import cv2

from gfpgan import GFPGANer

from realesrgan import RealESRGANer

# === 1. GFPGAN 設定 ===

gfpganer = GFPGANer(

model_path='experiments/pretrained_models/GFPGANv1.4.pth',

upscale=1, # GFPGAN内での倍率(後でRealESRGANで拡大するので1に)

arch='clean',

channel_multiplier=2

)

# === 2. Real-ESRGAN 設定 ===

realesrganer = RealESRGANer(

model_path='experiments/pretrained_models/RealESRGAN_x4plus.pth',

scale=4, # 最終倍率

model=None,

tile=0, # VRAMに応じて分割推論も可能

)

# === 入力画像の読み込み ===

img = cv2.imread('input.jpg', cv2.IMREAD_COLOR)

# === 3. 顔補正 ===

cropped_faces, restored_faces, restored_img = gfpganer.enhance(

img, has_aligned=False, only_center_face=False, paste_back=True

)

# === 4. アップスケーリング ===

output, _ = realesrganer.enhance(restored_img, outscale=4)

# === 保存 ===

cv2.imwrite('output.jpg', output)

print("処理完了: output.jpg")

</code></pre>

<!-- /wp:preformatted -->4. 実行のポイント

- 順序は GFPGAN → Real-ESRGAN が一般的です(顔を先に直してから拡大)。

- 両方の

.pthモデルは同じディレクトリに置いてもOKですが、スクリプト内のmodel_pathを正確に指定する必要があります。

GFPGAN の公式スクリプトを使って GFPGANとReal-ESRGANを自動連携させて画像処理する方法

GFPGANには--bg_upsampler realesrganというオプションがあり、背景処理にReal-ESRGANを使う方法。

※GFPGAN や Real-ESRGAN の依存関係(ライブラリやモデルファイル)をインストール済みであることが前提です。

以下のコマンドは、GFPGAN の公式スクリプトを使って GFPGANとReal-ESRGANを自動連携させて画像処理する ためのものです。

python inference_gfpgan.py -i inputs --bg_upsampler realesrgan意味:inference_gfpgan.py というスクリプトを実行して、inputs フォルダ内の画像を処理し、顔の修復には GFPGAN を使い、背景のアップスケール(高画質化)には Real-ESRGAN を使う、という内容です。

pythonPythonスクリプトを実行するためのコマンド。inference_gfpgan.py顔画像を修復するためのメインスクリプト。GFPGANの推論処理がここに書かれている。-i inputs -iは --input の略で、「入力画像のあるフォルダ」を指定する。ここでは inputs フォルダ内の画像を処理対象としている。--bg_upsampler realesrgan背景部分を高画質化する際に使用するアップスケーラーを指定。ここでは Real-ESRGAN を使用して背景もきれいにする設定。

追加オプション例:

-o output→ 出力先フォルダ指定--upscale 2→ 最終アップスケール倍率(2倍など)--model_path ...→ 使用するGFPGANモデルを直接指定

まとめ

- 初心者: Upscaylなどの簡易GUIが手軽

- 中級者: AUTOMATIC1111 / ComfyUI で統合・操作簡単

- 上級者: GitHubリポジトリから直接Pythonで処理・連携