ニューラルネットワークの仕組みを分かりやすく解説

ニューラルネットワークは、人間の脳の仕組みをモデルにしたAIのしくみで、特に、データを学習してパターンを見つけ、予測や判断を行うのに使われます。

目次

ニューラルネットワークの世界

「AIが画像を認識する」「文章を生成する」「音声を理解する」——

こうした魔法のような技術の裏側には、**“ニューラルネットワーク”**と呼ばれる仕組みがあります。

名前は聞いたことあるけど、なんだか難しそう…

そんなふうに感じる方も多いかもしれません。でも実はこの仕組み、「人間の脳の働きをヒントにして作られたもの」なんです。つまり、AIが賢くなっていくメカニズムは、人間の脳の働きと似た部分があるんですね。

この記事では、「ニューラルネットワークって結局なに?」という疑問を解消しながら、

できるだけ簡単に、しかも面白く!?その基本と応用についてご紹介していきます。

ニューラルネットワークは「判断工場」!?

ニューラルネットワーク(Neural Network)とは、人間の脳の神経細胞(ニューロン)を模倣して作られた、情報処理の仕組みです。

とはいえ、「ニューロン?なんか理科の授業で聞いたかも…」という感じですよね?

(いやいや、ニューロンくらい良く知ってる!って方は、ちょっと飛ばして下さい(;^_^A)

想像してみてください。

あなたはある工場の社長です。大量の写真がベルトコンベアで運ばれてきます。あなたの工場の仕事は「これは猫か?犬か?」を判断すること。

…でも、あなた一人じゃ全部見きれません。

そこで、**たくさんの小さな判断係(=ニューロン)**を雇います。

- 第一層の係は、「耳がとがっているか」「顔が丸いか」など特徴を拾う係。

- 第二層の係は、「この耳とこの顔はセットだな」とパターンを分析する係。

- 第三層の係が、「これは猫っぽい」と最終判断を出します。

これが、ニューラルネットワークのざっくりとした仕組みです。

たくさんのニューロン(判断係)が層になって情報を処理し、少しずつ賢くなっていくんですね。

ニューロンの役割はシンプル

1つ1つのニューロンは、実はとても単純です。

- 入力された情報に対して、「重み」をかけて

- 合計値が一定を超えたら「ON」にする

たとえば

「耳がとがっている」に +5、

「ヒゲがある」に +3、

合計が8になったら

「猫だと思う」といった感じ。

ただし、この判断は最初から正確ではありません。

失敗を繰り返して、「この重みじゃダメだったな」と調整していくことで、だんだんと正しい判断ができるようになります。これが「学習」です。

人間の脳とよく似ている?

この構造が、私たちの脳内で電気信号がやりとりされ、経験を通じて学んでいく過程とよく似ているため、

「ニューラル(神経の)ネットワーク」と呼ばれているのです。

SAKASA AI

ディープラーニングとは?AIの「ひらめき」の秘密を分かりやすく解説 | SAKASA AI この図はよく見るけど、この”ディープラーニング”ってどういう仕組みか分かる? この図だけで理解した気分にはなれるけどね。 (笑)確かにこの図は”スッ”と入ってくるね …

ニューラルネットワークはどうやって学習するのか?

試行錯誤を繰り返し”賢くなるAIくん”

先ほどの「判断係がたくさんいる工場」の例を思い出してください。

この工場は、最初から正しい判断ができるわけではありません。

例えば…

AIくん:「これは犬ですね!」

先生:「ブブー、それは猫でした~!」

AIくん:「えっ…じゃあ、ヒゲがあったのが決め手じゃなかったのかも…重みをちょっと下げよう…」

というふうに、間違えたときに「どこが悪かったか?」を見つけて、重みを微調整する。

これを何千回、何万回と繰り返していくことで、判断力がグングン上がっていきます。

この学習のプロセスは「誤差逆伝播法(ごさぎゃくでんぱほう)」と呼ばれるもので、

- 結果が間違っていたら

- どの係(ニューロン)の判断がズレてたかを

- 逆順にたどって修正していく

という、「先生が答案を赤ペンで直す」みたいな作業をAIが自動でやってるんです。

学習に必要なもの

ニューラルネットワークが成長するには、大きく3つの材料が必要です:

- 大量のデータ(例:猫と犬の画像と答え)

- 正解ラベル(例:「これは猫です」という答え)

- 学習アルゴリズム(間違いをどう直すかのルール)

この材料さえあれば、AIくんは失敗と反省を重ねて、やがて「猫アレルギーの人にとっても信頼できる画像判定マスター」に育ちます。

でも、落とし穴も…

「間違いから学ぶ」と言うと美しいですが、学習するデータに偏りがあったり、ノイズが多すぎたりすると、AIは妙なクセを覚えてしまうこともあります。

たとえば:

- 背景が芝生だと「犬」と思い込む

- 写真が白黒だと「猫」と誤判定しやすい

だからこそ、学習データの質やバランスもとても大切なんですね。

ニューラルネットワークは「たくさんの単純な判断係たちが、何度も間違えて、ちょっとずつ賢くなる仕組み」人間の成長とそっくり!

ニューラルネットワークの種類と画像生成AIへの応用

私たちの脳の仕組みをヒントに生まれた「ニューラルネットワーク」は、AIの心臓部とも言える存在です。特に画像生成AIにおいては、その発展なしに現在のようなリアルで美しいビジュアルは実現できなかったでしょう。ここからは、ニューラルネットワークの主要な種類と、それが画像生成AIにどう活かされているのかを、エピソードを交えて解説していきたいと思います。

ニューラルネットワークの種類と特徴

1. 全結合型(Fully Connected Network / FNN)

- 最も基本的な構造。

- 全てのニューロンが前後の層の全ニューロンと繋がっている。

- 画像や音声のような空間的構造を持たないデータの処理に適している。

逸話:最初期のAIブーム(1950~60年代)では、この単純な構造だけで「なんでもできる」と期待されていたが、実際には** XOR問題**などが解けずに挫折。これは「1つの構造で世界を理解するのは難しい」という、ある意味で哲学的な教訓を残しました。

2. 畳み込みニューラルネットワーク(CNN:Convolutional Neural Network)

- 画像処理に特化した構造。

- 画像の「ピクセル間の位置関係」を活かせる。

- フィルターで特徴を抽出 → プーリングで情報を圧縮 → 分類へ。

画像生成AIでの活用: CNNは、画像の“理解”に使われています。たとえば、写真のスタイルを解析したり、物体の位置を把握したり。MidjourneyやLeonardo.Aiのようなツールが、ユーザーの入力をもとに「どんな画像が求められているか」を読み取る際に活躍しています。

3. 再帰型ニューラルネットワーク(RNN:Recurrent Neural Network)

- 時系列データや文脈のあるデータ処理が得意。

- 「過去の情報を記憶しながら現在を処理する」構造。

画像生成AIでの応用: 画像生成AIのプロンプト(テキスト)理解に役立ちます。たとえば「黒髪の少女が未来都市で踊っている」といった複雑な文脈を、意味のかたまりに分解し、論理的に画像構成に結びつけるのは、こうした構造があるからこそ。

4. 生成モデル(GAN:Generative Adversarial Network)

- 画像生成の革命児。2014年にイアン・グッドフェローが提案。

- 2つのネットワーク(生成者と判別者)が対決する構造。

- 生成者(Generator):偽物画像を作る。

- 判別者(Discriminator):偽物か本物かを判定する。

- 対戦することで、どんどん精度が上がっていく。

面白い逸話:GANを提案したグッドフェローは、バーでの議論中にアイデアを思いついたそうです。しかも彼は、その研究を「ボスに秘密で」投稿したと言われています(※参考:Ian Goodfellow’s talk at NIPS 2016)。

画像生成AIでの活用: StyleGANやDisco Diffusionなどは、この仕組みを応用しています。MidjourneyやLeonardo.Aiも、初期のバージョンではGAN技術を取り入れており、まさに「AIがAIを鍛える」構造で、驚くほどリアルな画像を生み出してきました。

5. トランスフォーマー(Transformer)ベースの構造

- 現在の主流(特に自然言語処理・画像生成の融合)。

- 自由な「注意力(Attention)」を使って、重要な情報を選別。

- ChatGPTのような言語モデルにも使用されている。

画像生成AIでの応用: Stable Diffusion や DALL·E 2 は、Transformerをベースに画像を「言語として」扱いながら、画像生成を行います。これは「テキストとビジュアルの架け橋」として、これまでにない柔軟性をもたらしています。

おわりに:画像生成AIは“知性のモザイク”

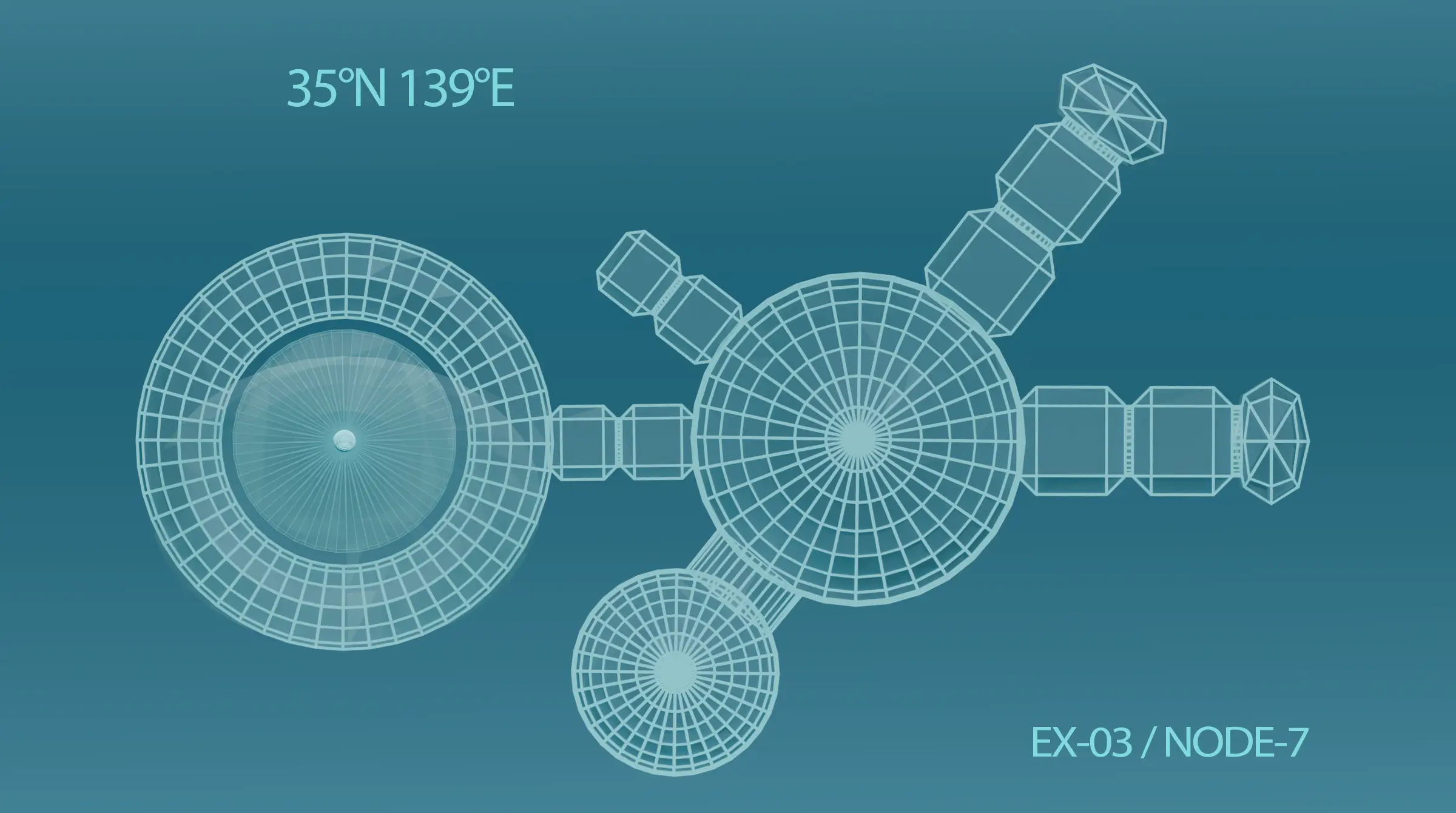

画像生成AIの裏側には、多様なニューラルネットワークが連携して動いています。

それぞれが「見る」「理解する」「想像する」「描く」といった異なる役割を担い、私たちの「こんな画像がほしい!」という思いに応えてくれるのです。

こうした知識を少し持っているだけで、プロンプト設計がうまくなったり、理想の画像に一歩近づけたりするかもしれません。

参考リンク(参照元)

OpenAI Blog: DALL·E

Ian Goodfellow: GANs original paper (2014)

What is a Neural Network? – IBM

How Transformers work – Jay Alammar