画像生成AIでキャラクターの顔を維持しつつ、再生成する!【5つの方法】▶ 2025.10.16更新

顔だけ変える方法が知りたい=この顔で生成したい

すごくいい画像が出来た!…けど、顔が好みじゃない。

このキャラの違うポーズが欲しい!

この 身体 に、かわいいあの子の顔を当てはめたい!

・・・などなど、イロイロな需要がありそうな、顔だけ変える方法について書いています。

未来

未来stable diffusion系がメインですが、クラウドで使える方法もありますよ。

SAKASA

SAKASAいいね~。今日はあの子の顔でコスプレ遊びでもしようかな。

セレナ

セレナあら、意外と健全ね。

目次

顔を維持しつつ再生成する方法(簡単で確実性順)

当記事では、画像生成AIでキャラクターの顔を維持しつつ再生成できる「顔だけ変えるすごい方法」をランキング形式で”5つ”ご紹介します。

顔だけ変える場合にも、顔以外を変える場合にも応用できます。

このランキングは手軽さと確実性の総合的な印象で順位付けしました。

第1位.Facefusion

”FaceFusion(フェイスフュージョン)”は、生成済みのキャラクター画像に別の顔を自然に合成できるフェイススワップツールです。

AIによる顔入れ替え・合成処理をリアルタイムで行い、

「顔の角度」「骨格」「目の距離」などを自動解析し、違和感なく合成してくれるのが特徴です。

LoRAやT2Iでは再現しづらい“同一キャラの多角度ショット”を作る際に重宝します。

バージョン3.4以降では、マスク生成と座標補正の精度が大幅に向上し、自然な仕上がりを実現しています。

アップスケール機能は持たないものの、キャラの顔を一貫して再生成したい場面に最適です。

未来

未来「ポーズ差分」作りにも使いやすい!

SAKASA

SAKASAホントに顔だけ変える事が出来るね。

使用方法は、以下の記事で解説しています。

簡単にフェイススワップできる

【FaceFusion 3.4.1】手軽に顔交換!フェイススワップ完全ガイド|GUI設定まで解説【RunPod対応】 FaceFusion v3.4.1 画像上の顔をそのままコピペするのではなく、顔の角度・骨格・目の距離・輪郭などを解析し、3D的な座標変換とマスク生成する。色補正や質感調整をリ…

レンタルクラウドGPUで”自作LoRA”を作成する方法はこちらで書いています。

あわせて読みたい

【RunPodの料金と使い方】Stable Diffusionなどで画像生成やLoRA学習をする方法【②実践編】 RunpodでStable Diffusion系画像生成やLoRA学習をする方法 Stable DiffusionやLoRA学習では、長時間GPUをフル稼働させるため、発熱や電源の安定性が大きな課題になりま…

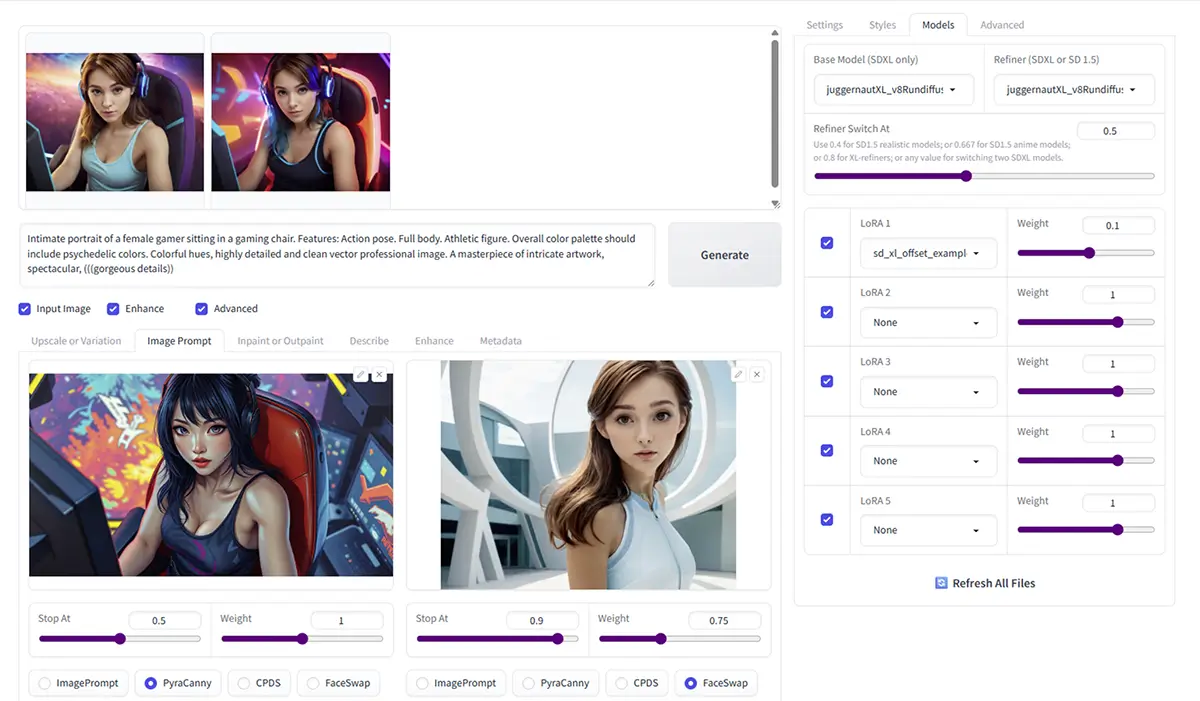

第2位. Fooocusの顔置き換え

こちらも、stable diffusion 系のツールです。

顔だけ変える場合はもちろん、顔の骨格を読み取って、角度や構図を変える事が出来ます。

1位でご紹介した、Facefusionの様に顔だけを入れ替えるという用途よりも、顔の特徴を保って再生成するという方向性です。

顔を維持した状態で、プロンプトで雰囲気を変えたり、背景や衣装を変える事が出来ます。

Fooocusの顔置き換えは使いやすい

- 自動マスク生成

- 顔の部分だけを自動検出してマスクを切り出します。

- 通常のControlNetだと「自分で顔部分をマスク」する必要がありますが、FooocusはUIに統合されていて手間がない。

- 領域限定の再生成

- 検出した顔領域だけを「部分的にinpaint」する仕組み。

- 背景や髪の毛を壊さずに、顔だけを自然に置き換えることができます。

- ControlNetの併用

- 背景やポーズを固定したまま、顔部分だけを再生成。

- これにより「顔は変わるけど構図は崩れない」仕上がりに。

- Fooocus流の自動調整

- ストレングス(強さ)やマスク範囲を自動調整しているので、ユーザーは細かく設定しなくても自然に仕上がる。

- ControlNetやInpaintをそのまま使うより、成功率が高いのはこの工夫のおかげの様です。

詳しくはこちらの記事で書いています。【Fooocusの使い方】使いやすい!おすすめ画像生成AI【Stable Diffusion】

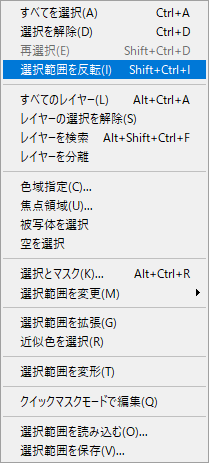

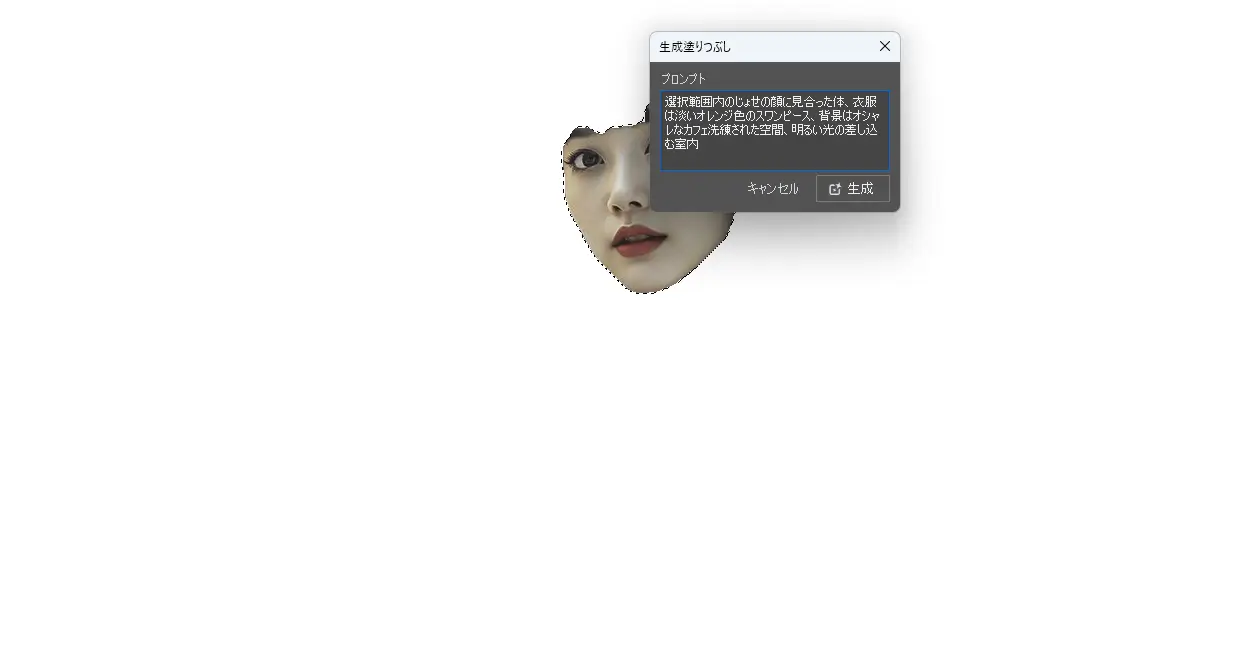

第3位. Photoshop(生成塗りつぶし)で編集

3位は、StableDIffusionではありません。最近急速に進化している、**Photoshopの生成AI機能”です。

仕上がりの早さと精度で見ても、恐らくこれが一番早いような・・・気がしている今日この頃です。ただ、ちょくちょく、とんでもない画像になる事もあるのですが・・・(なぜ?)

気に入らない箇所を、削除ツールを使用して少しずつ画像生成をするのがおすすめです。

この機能は、Photoshopで削除ツールからの、生成塗りつぶしです。

一まずは、ポーズはさほど変えず、それでいて衣服、もしくは髪型は変えたい場合についてです。

プロンプトを入力して、生成。

※削除ツール段階での粗さはお許しください。

ポイントとしては、部分ごとの生成を段階を踏んでいく事で、完成度を上げる事が出来ます。

本当に顔パーツ以外変えたい!ポーズも変えたい!!という場合

そうですよね。少し保身に走っていましたが、最も難易度の高い顔のみ保持についてです。※事故が起こりやすいですので時間の余裕をもってお試しください。

ここからは、先ほどと同じ工程背景を”クイック選択ツール”で選択後、”編集”から”生成塗りつぶし”を選択し、プロンプトを入力して、生成。

体の向きも変わっていますし、顔と首の境目も自然ですね。ただ、構図が変わらないという問題が残っています。

構図を大きく変えたい場合は、もう一工程は必要です。

そして、くり抜いた顔を、ファイル書き出しWeb用に保存.pngで一旦、保存します。

Photoshopファイルから新規作成で新しいファイルを開き、先ほどくり抜いた顔を好きな位置に配置します。

必要であれば向きを変える事ぐらいは出来ます。(左右反転)

今回の顔は、少し暗めなので一旦、顔色も調整しました。その後、レイヤーが分かれていると”削除ツール”が使えないのでレイヤーを結合し、もう一度、先程の工程を繰り返します。

顔の向きを変形で変え、更に画像補正、明度彩度の変更と、輪郭補正をして、生成をしました。ここまでくると先程の女性とは思えません。

画像生成AIの特性を利用

(…にしても、くり抜き削除が雑ですみません…)

余計な情報を(背景、もしくは衣服なども)消した(背景は単色)画像を用いて再度、Image-to-Imageへ!

無限ループになる可能性も否めませんが、しつこく諦めない気持ちが大切です(涙)!

第4位. 顔の参照画像を ControlNet(Reference Only / IP-Adapter)で指定

Stable Diffusion WebUI や ComfyUI で利用できる機能です。

手間がかかるので4位かな・・・。

Stable Diffusion系のAutomatic1111や、ComfyUIを使用して、拡張機能であるControlNetを使用して生成する方法です。

参照画像を用意して、生成時に「顔構造を強制的に反映」させることができます。

- LoRAを作るほどでもない短期利用に便利

- 元画像をベースに「似た顔」を出すのに向いている

この機能は、全く同じ顔になるというよりも、似た顔、似た骨格、にコントロールできるという特性があります。

ツールに慣れるのに少し時間が掛かるけど、実は本命なのは、ComfyUIのControlNet系テンプレートを使う方法で、ControlNetにさらに顔画像を指定して生成したり、消したい箇所をマスクして生成をしたりする事も出来ます。

Stable Diffusion WebUI や ComfyUI を使用できる環境があればすぐに使える手軽さが魅力ですが、思い通りに使いこなすのには、時間も掛かります。

最も手軽な方法は、RunpodのStable Diffusion系テンプレート【Stable Diffusion WebUI Forge】(初めからmodelsやControlNetがセットになっている)を使用して生成する方法です。

あわせて読みたい

【ControlNetの使い方】完全ガイド|線画・ポーズ・輪郭で思い通りに画像生成する方法 ControlNetは、「拡張機能・追加機能」です。ControlNet自体はStable Diffusionに、条件(姿勢・線画・輪郭など)を与えて画像生成をコントロールするためのモデルや技…

第5位. LoRA / DreamBooth でキャラクター学習

「同じキャラクターの顔を維持しつつ、構図を変える」ことは非常に難しいですが、いろいろなポーズという意味で言うと、再現性が高いのは Stable Diffusion系LoRAやDreamBoothを用いて学習させる方法 では無いでしょうか。

この方法では、同じ顔のキャラクター画像を複数枚用意して学習し、自作LoRAを作成します。これにより、背景やポーズを変えても一貫性のあるキャラクターを再現可能です。

ただ、この方法は、難易度というよりも、工程が多く時間が掛かります。

LoRA → 軽量で学習が早く、数十枚の画像から作成可能

DreamBooth → より本格的で安定度が高いが、VRAMや時間が多く必要

長期的にオリジナルキャラを使い続けたいなら必須の方法です。

ローカル環境「自分のPC)で”自作LoRA”を作成する為の詳しい方法については、こちらの記事で書いています。

ローカルPCでLoRA学習する方法

【初心者向け】自作LoRAの作り方|Kohya_ssで学習する方法|Anaconda + CUDA【Windows】 ローカル環境構築から学習までを解説 この記事では、LoRAをKohya_ssで学習する為の環境構築からKohya_ssを開くまでの手順を解説しています。 LoRAモデルの概要、モデル…

【 おまけ 】

img2img(部分的な再生成・マスクInpainting)

Stable Diffusion系(Automatic1111 / ComfyUI / InvokeAIなど)で標準的に使える方法です。

- Stable Diffusion WebUI (Automatic1111)

img2imgタブで元画像を読み込む- 「顔の部分だけマスクを外す / 残す」を設定して再生成

- ストレングス(Denoising strength)を 0.3〜0.6 にすると「顔は維持、他は変化」しやすい

- 0.8 以上にすると顔も崩れることが多い

- ComfyUI

LoadImage→Mask→KSamplerで部分的に再生成- ワークフロー次第で背景だけ変えたり、顔だけ残したりも可能

- InvokeAI

- 「inpainting」機能で同様のことができる

ポイント

つまり Stable Diffusion 系の代表的な「顔を残して再生成する」機能 が img2img です。

「既存画像の顔を保ちつつ微調整したい」**ときにおすすめです。

どのAIが一番制御しやすいのか?

| AIモデル | キャラの一貫性 | 制御のしやすさ | おすすめ用途 |

|---|---|---|---|

| Leonardo.Ai | ◎(専用機能あり) | 簡単 | ゲーム・アニメキャラの継続生成 |

| Stable Diffusion(ControlNet + LoRA) | ◎(訓練すれば可能) | 上級者向け | カスタムキャラ・オリジナル作品 |

| Midjourney | △(再現度は低め) | 普通 | 背景重視・スタイル優先 |

| DALL·E | ◯(Inpainting活用) | 初心者向け | 画像修正・部分変更 |

Leonardo.Ai(レオナルドAI)

- 特徴: 「Character Consistency」機能を搭載(プロバージョン)

- 方法:

- 参照画像をアップロード(Reference Image)

- 「Character Consistency」をONにする

- 同じキャラの異なるポーズを生成可能

Midjourney

- 特徴: バージョン6からキャラクターの一貫性が向上

- 方法:

- 「Image Reference」 を使用(画像URLをプロンプトに追加)

- 同じ構図・スタイルで再現を試みる

- ただし、完全に一致させるのは難しい

方法1:プロンプトで「背景のみ」を明示する

Midjourneyでは、以下のようにプロンプトで明確に指定します

ポイント

- 「background」や「scenery」を強調

- 「no people」「no objects」などで不要要素を排除

- 必要に応じて –ar(アスペクト比) を使って横長・縦長に調整

方法2:ネガティブプロンプト(Niji・v6以降)

Midjourney v6からは「ネガティブプロンプト(不要なものを除外)」も自然に扱えるようになっています

misty mountains landscape background, no characters, no text, no animals --v 6 --ar 2:1これにより、純粋な自然風景、都市風景、空、抽象背景などがキレイに出力されます。

方法3:被写体を小さくして背景を主役にする

どうしても「背景+人物」になるときは、以下のように構図で背景を主役に

a wide shot of a futuristic city skyline, with a very small figure in the distance --v 6 --ar 3:2背景だけのプロンプト例

| 背景タイプ | プロンプト例 |

|---|---|

| 空想的な森 | fantasy forest background, glowing plants, no people, no buildings --v 6 |

| サイバーパンク都市 | cyberpunk cityscape background, neon lights, no characters, cinematic --v 6 --ar 16:9 |

| 星空・宇宙空間 | deep space galaxy background, stars, nebula, no spacecraft, no text --v 6 |

| 抽象背景 | abstract minimal background, soft gradient, pastel colors, no elements --v 6 |

注意点

- Midjourneyは構図を完全にはコントロールできないこともあるので、複数回生成して選別が必要です。

- 被写体を自動で切り分けて「背景だけ抽出」はできないので、あくまで「背景だけを生成する」形になります。

DALL·E(OpenAI)

- 特徴: 「Inpainting(編集機能)」を活用してキャラを部分修正可能

- 方法:

- 一度生成したキャラの一部を編集し、新しいポーズや服装を変更可能

- ただし、細かい制御は難しい

背景生成ができる人気AIツール一覧(2025年版)

| ツール名 | 背景の種類 | 特徴 | 無料プラン |

|---|---|---|---|

| Adobe Photoshop(Firefly) | 写実/写真向け | 「生成塗りつぶし」で背景をAI生成。自然で高品質。 | 一部あり(Adobe CC契約必要) |

| Canva(Magic Edit) | 写真/イラスト/SNS | 簡単操作で背景編集。SNSやプレゼン素材に最適。 | ◎(一部制限あり) |

| Clipdrop by Stability AI | 写真/合成 | 背景削除、置換、補完など軽快。リアル寄り。 | ◎(制限付き) |

| Remove.bg | 写真/人物用 | 超高速な背景削除特化。品質も高い。 | ◎(HDは有料) |

| D-ID Creative Reality™ | 背景+顔アニメ合成 | 顔写真+背景をAIで作って、アバター生成も可能。 | △(体験あり) |

| Fotor AI Background Remover | 写真/商品画像向け | EC用画像に最適。切り抜きや背景変更が得意。 | ◎ |

| ZMO AI | モデル写真/ファッション | 人物写真の背景や衣装までAIで変更可能。 | ◎(プロ機能は有料) |

| Leonardo.Ai | アート/幻想風 | Text-to-Imageで美しい背景生成が可能。スタイルも多彩。 | ◎(使用回数制限あり) |

| Midjourney | アート/幻想風 | 高精細な幻想的背景が得意。Promptで完全生成。 | △(有料サブスクリプション) |

用途別おすすめ

写真をベースに背景を変更・削除したい場合

→ Remove.bg、Photoshop、Canva、Clipdrop

SNSやプレゼン資料、ポスター制作などに使いたい場合

→ Canva(Magic Edit)

→ Fotor(商用利用向け)

アートや空想的な背景を生成したい場合

→ Leonardo.Ai、Midjourney、Runway

機能別まとめ

| 機能 | 対応ツール例 |

|---|---|

| 背景削除(切り抜き) | Remove.bg、Canva、Clipdrop、Photoshop |

| 背景を新たにAI生成 | Runway、Photoshop、Leonardo.Ai、Midjourney |

| 背景の一部を補完・修復 | Runway(Inpainting)、Photoshop、Clipdrop |

| テキストから背景生成 | Runway、Leonardo.Ai、Midjourney、Canva |

時間の余裕ある場合はLoRAをお勧めします。

あわせて読みたい

LoRAとは?仕組み・学習・使い方・学習パラメータまで【LoRA完全ガイド】 LoRAとは何か? LoRAとは、Low-Rank Adaptation(低ランク適応)の略で、大規模なモデル(例:Stable Diffusion)の重みをすべて再学習するのではなく、一部だけを効率…

画像生成で指の数や形を整えたい時

SAKASA AI

【生成画像の指の数や手の形を直したい時】Stable Diffusion 系プロンプトのコツとその他の方法 | SAKASA A… 生成画像の指の数や手の形を直したい時 最近では、ComfyUIの内で、Qwen×ComtrolNetを使用すれば、そもそも変な手や、変な指の形状が生成されることが極めて少なくなってき…